简介

简介

Clipfly是什么

Clipfly是一个一站式AI视频制作平台,由成都恒图科技(AI图像工具Fotor背后的公司)开发,旨在为用户提供从创意产生到完成视频的全套解决方案。该产品集成了多种功能,包括AI视频生成、AI视频增强、视频编辑等,使用户能够在一个平台上完成从文本到视频的转换和编辑。Clipfly的目标是简化视频制作流程,使得任何用户,无论是否具备专业的视频编辑技能,都能够轻松地创作出高质量的视频内容。

Clipfly的主要功能

AI视频生成:用户可以通过输入文本提示词(Prompt)来生成视频帧(Frame),Clipfly会根据这些文本提示词生成相应的视频内容,支持如摄影、动画、概念风、电影等不同风格的视频生成。视频编辑器:Clipfly内置了一个视频编辑器,允许用户对生成的视频片段进行剪辑、添加字幕、音乐等,以及进行其他常规的视频编辑任务,如调整视频长度、裁剪画面等。视频增强:该功能可以帮助用户提升视频画面质量,通过自动调整视频的亮度、饱和度、对比度等参数,使得视频看起来更加生动和专业。照片动画制作:用户可以利用这个功能让静态照片动起来,为照片添加动态效果,使其更具吸引力和趣味性。口播虚拟人:Clipfly提供了一个独特的功能,可以将照片中的人物头像转换成说话的虚拟人,通过自然的声音覆盖,使得照片看起来像是在说话。视频清晰度增强:对于质量不高或拍摄条件不理想的视频,Clipfly提供了视频清晰度增强工具,可以改善视频的清晰度,提升观看体验。媒体库资源:Clipfly提供了丰富的媒体库资源,包括贴纸、图片、音乐、转场效果和文本效果等,用户可以直接使用这些资源来丰富和个性化自己的视频。

如何使用Clipfly生成视频

访问Clipfly的官网(clipfly.ai),点击Try for free,然后进行注册/登录点击顶部的AI Tools菜单栏,选择AI Video Generator,然后点击Get Started在Prompts处输入提示词,选择视频帧(Frames)数量,然后点击Geneate Frame最后选择视频帧画面,点击Generate a Video生成视频,等待视频生成视频生成完毕后,可进行下载,也可以继续生成视频片段合并为长视频Clipfly的产品价格

免费版:新用户注册后可获得免费的20个AI积分,1视频帧生成消耗1积分,1个视频生成消耗5积分,视频画质增强每分钟视频消耗5积分。Pro付费版:14.99美元每月(99.99美元每年),每月提供200个积分,支持4K画质视频导出、1200+音频素材、39000+版权贴纸、5500+版权图片、100+版权视频、210+字体、2G+云存储、音频提取、导出视频为MP3等权益。

免费版:新用户注册后可获得免费的20个AI积分,1视频帧生成消耗1积分,1个视频生成消耗5积分,视频画质增强每分钟视频消耗5积分。Pro付费版:14.99美元每月(99.99美元每年),每月提供200个积分,支持4K画质视频导出、1200+音频素材、39000+版权贴纸、5500+版权图片、100+版权视频、210+字体、2G+云存储、音频提取、导出视频为MP3等权益。  相关资讯

更多+

相关资讯

更多+

-

FlipSketch – 萨里大学推出的文本引导生成无约束草图动画的AI系统

FlipSketch – 萨里大学推出的文本引导生成无约束草图动画的AI系统FlipSketch 是萨里大学推出的创新系统,能将静态绘图转变为文本引导的草图动画。技术基于三个关键创新实现:微调草图风格的帧生成、用噪声细化保持输入草图视觉完整性的参考帧机制,及在不失去视觉一致性的情况下实现流畅运动的双注意力合成。

AI教程资讯

2025-02-02

2025-02-02

-

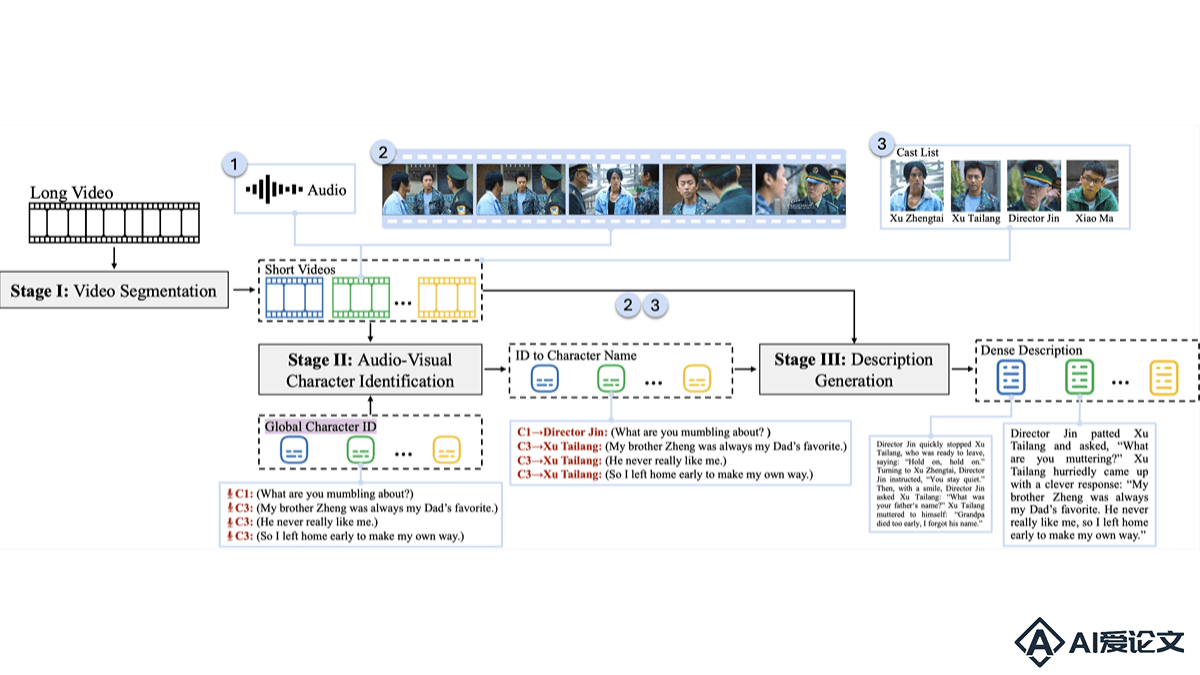

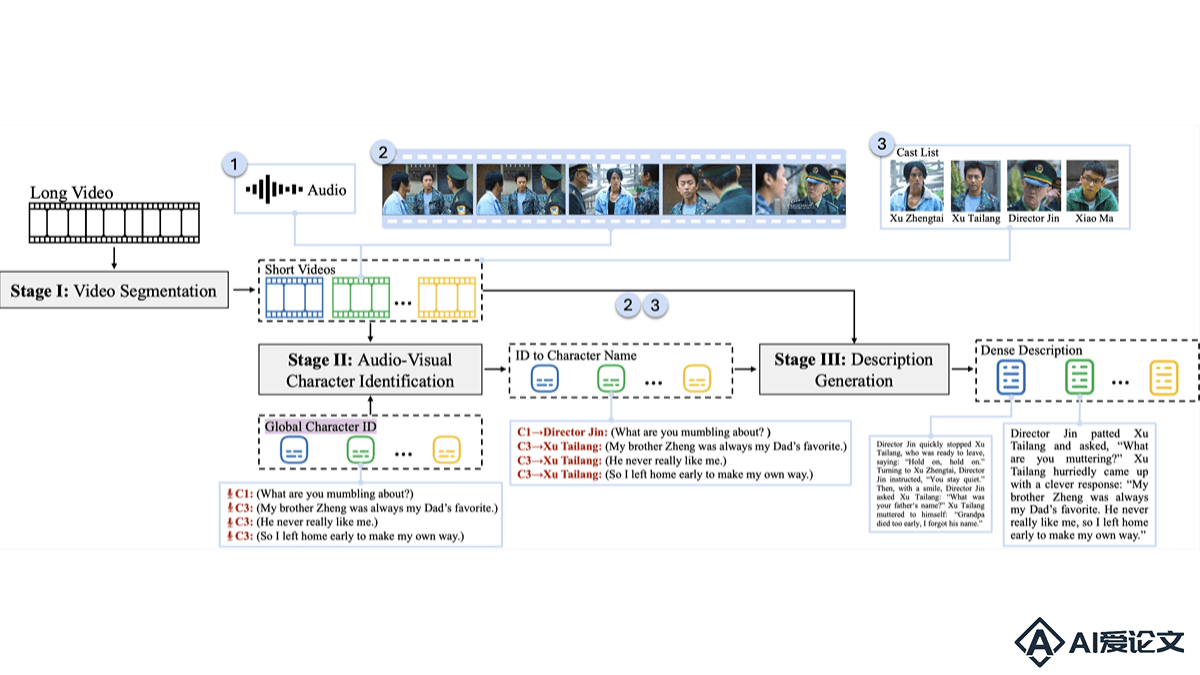

StoryTeller – 字节、上海交大、北大共同推出的全自动长视频描述生成一致系统

StoryTeller – 字节、上海交大、北大共同推出的全自动长视频描述生成一致系统StoryTeller是字节跳动、上海交通大学和北京大学共同推出的系统,能基于音频视觉角色识别技术改善长视频描述的质量和一致性。系统结合低级视觉概念和高级剧情信息,生成详细且连贯的视频描述。StoryTeller由视频分割、音频视觉角色识别和描述生成三个主要模块组成,能有效处理数分钟长的视频。

AI教程资讯

2025-02-02

2025-02-02

-

DELIFT – 数据高效语言模型指令微调算法

DELIFT – 数据高效语言模型指令微调算法DELIFT(Data Efficient Language model Instruction Fine-Tuning)是新型算法,用在优化大型语言模型(LLMs)在指令调优、任务特定微调和持续微调三个关键阶段的数据选择。基于成对效用度量和次模优化技术,高效选择多样化和最优的数据子集,减少计算资源消耗,同时保持或提升模型性能。

AI教程资讯

2025-02-02

2025-02-02

-

HART – 麻省理工学院推出的自回归视觉生成模型

HART – 麻省理工学院推出的自回归视觉生成模型HART(Hybrid Autoregressive Transformer)是麻省理工学院研究团队推出的自回归视觉生成模型。能直接生成1024×1024像素的高分辨率图像,质量媲美扩散模型。HART基于混合Tokenizer技术,将自动编码器的连续潜在表示分解为离散token和连续token,其中离散token负责捕捉图像的主要结构,连续token专注于细节。

AI教程资讯

2025-02-02

2025-02-02

最新录入

更多+

最新录入

更多+

同类别攻略

更多+

同类别攻略

更多+

- 星火纪要 – 科大讯飞推出的会议交流总结和分析平台 2025-01-13

- Agent Laboratory – AMD 联合约翰·霍普金斯大学推出的自主科研 Agent 2025-01-13

- LatentSync – 字节联合北交大开源的端到端唇形同步框架 2025-01-15

- Diff-Instruct – 从预训练扩散模型中迁移知识的通用框架 2025-01-20

- 日日新融合大模型 – 商汤科技推出的原生融合模态大模型 2025-01-13

- Search-o1 – 人大联合清华推出自主知识检索增强的推理框架 2025-01-13

同类别推荐

更多+

同类别推荐

更多+

-

Clipfly

查看

Clipfly

查看

-

LTX Studio

查看

LTX Studio

查看

-

Magicam

查看

Magicam

查看

-

Wonder Studio

查看

Wonder Studio

查看

-

闪剪

查看

闪剪

查看

-

蝉镜

查看

蝉镜

查看

热门推荐

更多+

热门推荐

更多+

- SPAR3D – Stability AI等机构推出的单试图重建 3D 网络模型 01-13

- 星火纪要 – 科大讯飞推出的会议交流总结和分析平台 01-13

- Agent Laboratory – AMD 联合约翰·霍普金斯大学推出的自主科研 Agent 01-13

- 日日新融合大模型 – 商汤科技推出的原生融合模态大模型 01-13

- LatentSync – 字节联合北交大开源的端到端唇形同步框架 01-15

- Diff-Instruct – 从预训练扩散模型中迁移知识的通用框架 01-20

- Search-o1 – 人大联合清华推出自主知识检索增强的推理框架 01-13

- rStar-Math – 微软推出的小模型复杂推理与自进化SLMs的创新技术 01-13

- Mobile-Agent – 自主多模态移动设备代理,通过视觉感知实现智能化手机操作 01-14

- CHRONOS – 阿里通义联合上海交大等推出时间线摘要生成新框架 01-14

查看

查看

LTX Studio

查看

LTX Studio

查看

Magicam

查看

Magicam

查看

Wonder Studio

查看

Wonder Studio

查看

闪剪

查看

闪剪

查看

蝉镜

查看

蝉镜

查看