简介

简介

2021年6月,北京智源研究院(BAAI)推出了悟道1.0的后续版本悟道2.0,作为中国第一个超大规模智能模型系统。悟道是一个语言模型,旨在在人类层面的思维上超越 OpenAI 的 GPT-3 和谷歌的 LaMDA。经过4.9TB的图像和文本训练,并在9个基准上超过了最先进(SOTA)水平,悟道比任何同行都更接近于实现通用人工智能(AGI)和人类水平的思维。

悟道接受了4.9 TB高质量英文和中文图像和文本的训练:

1.2TB中文文本数据2.5TB中文图形数据1.2TB英文文本数据悟道是基于开源的 MoE 系统 FastMoE 进行训练的。MoE是一种机器学习技术,其工作原理如下:

将预测建模任务划分为子任务,针对每个子任务训练专家(学习者)模型,开发门控模型,该门控模型基于要预测的输入来学习咨询哪个专家,并组合预测。FastMoE使悟道能够并行咨询不同的专家模型,并切换到预测结果最好的模型。例如,如果输入是英文文本,悟道将使用预测模型,该模型可以在英文文本中生成回应。

相关资讯

更多+

相关资讯

更多+

-

Ichigo – 开源的多模态AI语音助手,实时处理语音和文本的交织序列

Ichigo – 开源的多模态AI语音助手,实时处理语音和文本的交织序列Ichigo是开源的多模态AI语音助手,采用混合模态模型,能实时处理语音和文本的交织序列。基于将语音直接量化为离散令牌,用统一的变换器架构同时处理语音和文本,实现跨模态的联合推理和生成。

AI教程资讯

2025-02-10

2025-02-10

-

CogSound – 智谱AI最新推出的音效模型

CogSound – 智谱AI最新推出的音效模型CogSound是智谱AI最新推出的音效模型,能为无声视频增添动人的音效。 基于GLM-4V的视频理解能力,CogSound能精准识别理解视频背后的语义和情感,为无声视频添加与之相匹配的音频内容,可以生成更复杂的音效,如爆炸、水流、乐器、动物叫声、交通工具声等。

AI教程资讯

2025-02-10

2025-02-10

-

AgentSquare – 清华推出模块化智能体系统设计和搜索新框架

AgentSquare – 清华推出模块化智能体系统设计和搜索新框架AgentSquare是清华大学团队推出自动搜索和优化大型语言模型(LLM)代理的框架。基于标准化的模块接口抽象,实现AI智能体的高速自我演化和自适应演进。框架包含任务规划、常识推理、工具使用和记忆学习四个核心模块,支持智能体针对不同任务场景的优化设计。

AI教程资讯

2025-02-10

2025-02-10

-

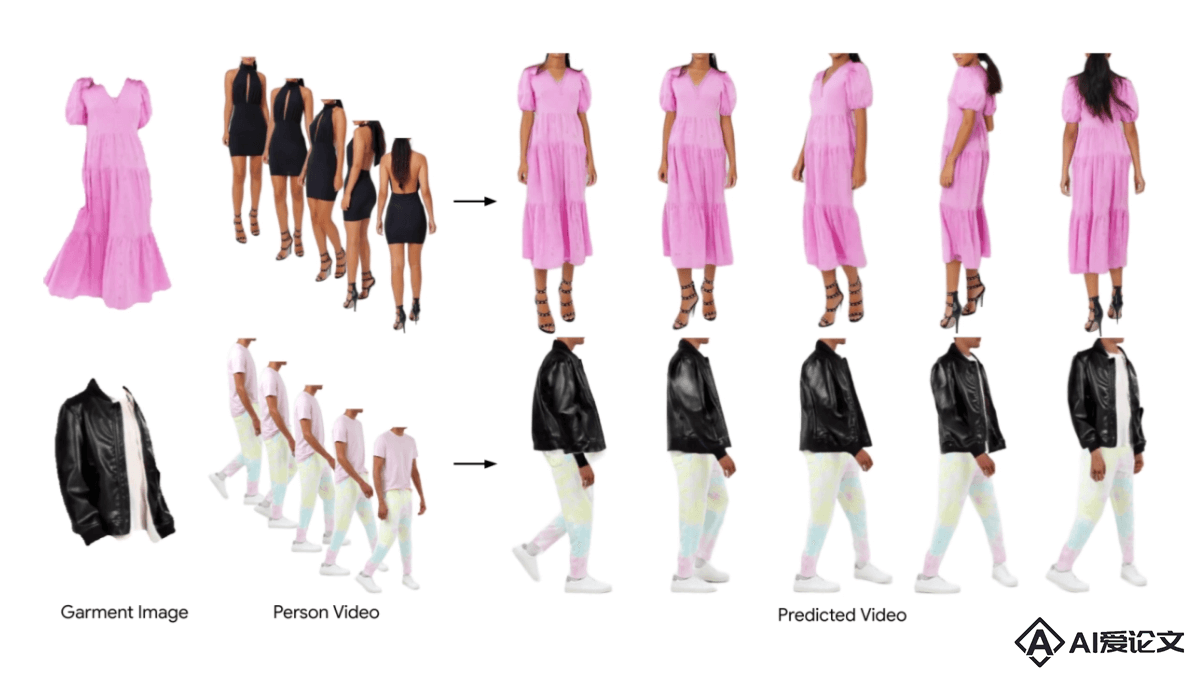

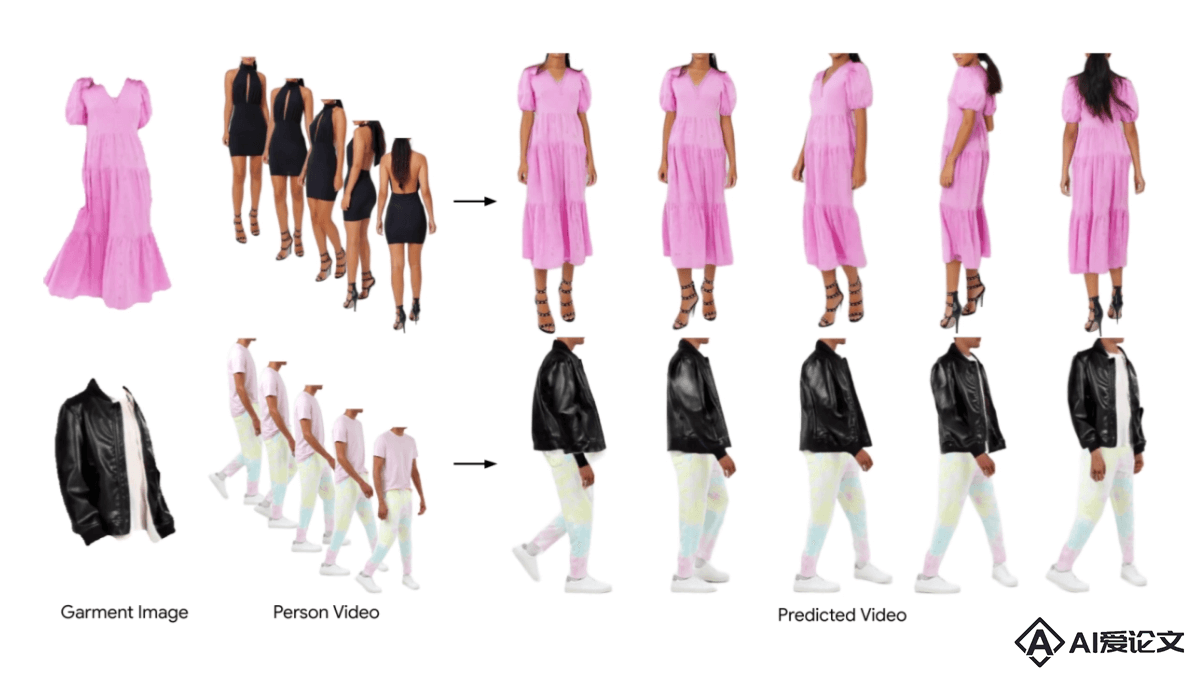

Fashion-VDM – 谷歌和华盛顿大学联合推出的虚拟试穿技术

Fashion-VDM – 谷歌和华盛顿大学联合推出的虚拟试穿技术Fashion-VDM是谷歌和华盛顿大学共同推出的基于视频扩散模型(VDM)的虚拟试穿技术。能在给定服装图像和人物视频的情况下,生成人物穿着指定服装的高质量试穿视频,保留人物的身份和动作。Fashion-VDM基于扩散模型架构、分割分类器自由引导和渐进式时间训练策略,解决视频虚拟试穿中服装细节和时间一致性的问题。

AI教程资讯

2025-02-10

2025-02-10

最新录入

更多+

最新录入

更多+

同类别攻略

更多+

同类别攻略

更多+

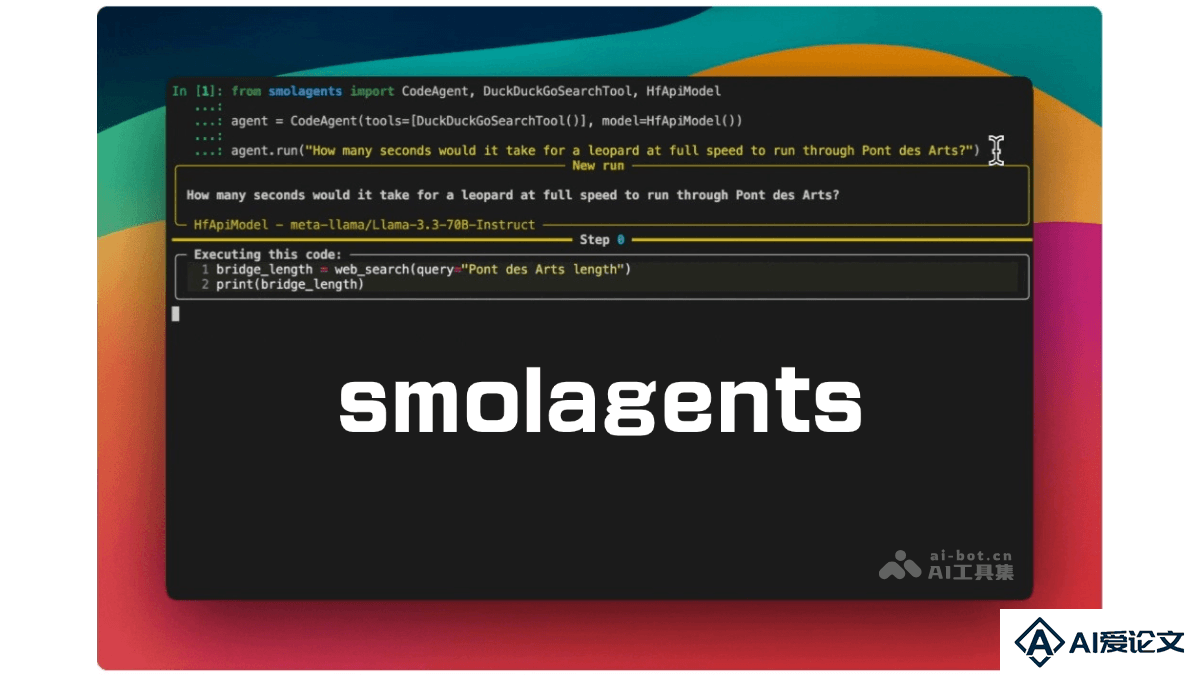

- smolagents – Hugging Face 开源的轻量级 Agent 构建库 2025-01-15

- Agent Laboratory – AMD 联合约翰·霍普金斯大学推出的自主科研 Agent 2025-01-13

- 日日新融合大模型 – 商汤科技推出的原生融合模态大模型 2025-01-13

- ConceptMaster – 高保真多概念视频定制生成的创新 AI 框架 2025-01-13

- Search-o1 – 人大联合清华推出自主知识检索增强的推理框架 2025-01-13

- SPAR3D – Stability AI等机构推出的单试图重建 3D 网络模型 2025-01-13

同类别推荐

更多+

同类别推荐

更多+

-

悟道

查看

悟道

查看

-

魔搭社区

查看

魔搭社区

查看

-

Ollama

查看

Ollama

查看

-

AgentGPT

查看

AgentGPT

查看

-

Jan

查看

Jan

查看

-

Auto-GPT

查看

Auto-GPT

查看

热门推荐

更多+

热门推荐

更多+

- SPAR3D – Stability AI等机构推出的单试图重建 3D 网络模型 01-13

- 星火纪要 – 科大讯飞推出的会议交流总结和分析平台 01-13

- Agent Laboratory – AMD 联合约翰·霍普金斯大学推出的自主科研 Agent 01-13

- 日日新融合大模型 – 商汤科技推出的原生融合模态大模型 01-13

- Search-o1 – 人大联合清华推出自主知识检索增强的推理框架 01-13

- LatentSync – 字节联合北交大开源的端到端唇形同步框架 01-15

- Diff-Instruct – 从预训练扩散模型中迁移知识的通用框架 01-20

- rStar-Math – 微软推出的小模型复杂推理与自进化SLMs的创新技术 01-13

- Mobile-Agent – 自主多模态移动设备代理,通过视觉感知实现智能化手机操作 01-14

- CHRONOS – 阿里通义联合上海交大等推出时间线摘要生成新框架 01-14

查看

查看

魔搭社区

查看

魔搭社区

查看

Ollama

查看

Ollama

查看

AgentGPT

查看

AgentGPT

查看

Jan

查看

Jan

查看

Auto-GPT

查看

Auto-GPT

查看