简介

简介

职得简历是什么

职得简历是在线AI简历生成工具,提供智能内容生成、自动排版和多模板选择。用户输入岗位信息,可快速生成专业简历,能上传旧简历进行AI优化。职得简历包含模拟面试功能,帮助求职者提升面试技巧。职得简历旨在简化简历制作,增强求职竞争力。

职得简历的主要功能

AI简历生成:通过输入岗位名称和工作年限,AI技术自动生成匹配的简历内容。简历优化:上传现有简历,AI提取并优化内容,提升简历的专业性和吸引力。美化排版:提供多种简历模板,自动完成排版,满足个性化需求。模拟面试:在线模拟真实面试场景,帮助用户练习面试技巧。题库搭建:根据简历内容生成面试问答题库,提供常见问题及回答话术。免费定制:提供免费简历定制服务,用户可以免费导出PDF或Word格式的简历。跨平台编辑:支持在不同设备上编辑简历,实现无缝衔接。一键式中英文翻译:方便用户一键翻译简历,适应不同语言环境的求职需求。如何使用职得简历

访问平台:访问职得简历的官方网站。注册/登录:新用户注册账户,老用户直接使用账户信息登录。选择服务:登录后,根据需要选择相应的服务,如AI简历生成、简历优化、模拟面试等。AI简历生成:选择“AI简历生成”功能,输入岗位名称和工作年限,系统会根据提供的信息自动生成简历草稿。上传简历优化:选择“简历优化”功能,上传简历文件,AI将分析提供优化建议,可以根据这些建议修改简历。选择模板美化排版:在“美化排版”功能中,选择喜欢的简历模板。根据模板指示填充或调整内容,预览并保存。模拟面试练习:选择“模拟面试”功能,系统会提供模拟面试问题。练习回答这些问题,提高实际面试中的表现。题库搭建:用“题库搭建”功能,根据简历内容生成面试问答题库。准备可能在面试中出现的问题。免费定制简历:完成简历编辑后,可以免费导出为PDF或Word格式的文件。一键式中英文翻译:需要将简历翻译成英文,使用“一键式中英文翻译”功能。下载和分享:将完成的简历下载到本地,或通过平台直接分享给招聘方。职得简历的产品定价

提供基础的免费服务,包括简历生成、导出和部分功能体验,具体的付费细节和价格,可以访问职得简历的官方网站进行详细了解。职得简历的应用场景

职场新人:对于刚开始写简历的求职者,职得简历可以帮助他们快速搭建简历框架,提供简历内容的生成和优化。简历优化:对于已有简历但希望提升内容和排版的用户,平台可以提供简历内容的润色和样式调整。面试准备:所有求职者都可以通过模拟面试功能来练习面试技巧,提高面试表现。兼职项目:对于从事简历代制作或在线求职辅导的兼职者,职得简历可以作为辅助工具,提高工作效率和质量。技能提升:用户可以通过平台学习不同行业的技能要求,辅助构建岗位技能知识体系。应届毕业生求职:帮助没有工作经验的毕业生制作出符合企业要求的简历,突出教育背景和校园活动经验。 相关资讯

更多+

相关资讯

更多+

-

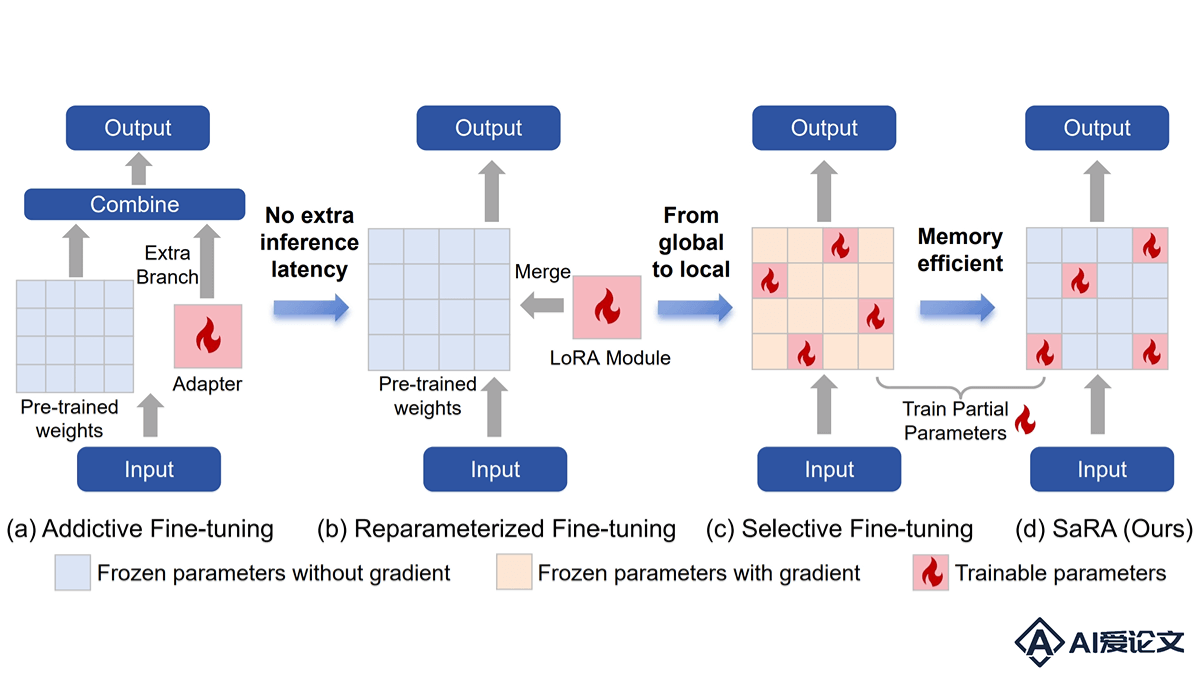

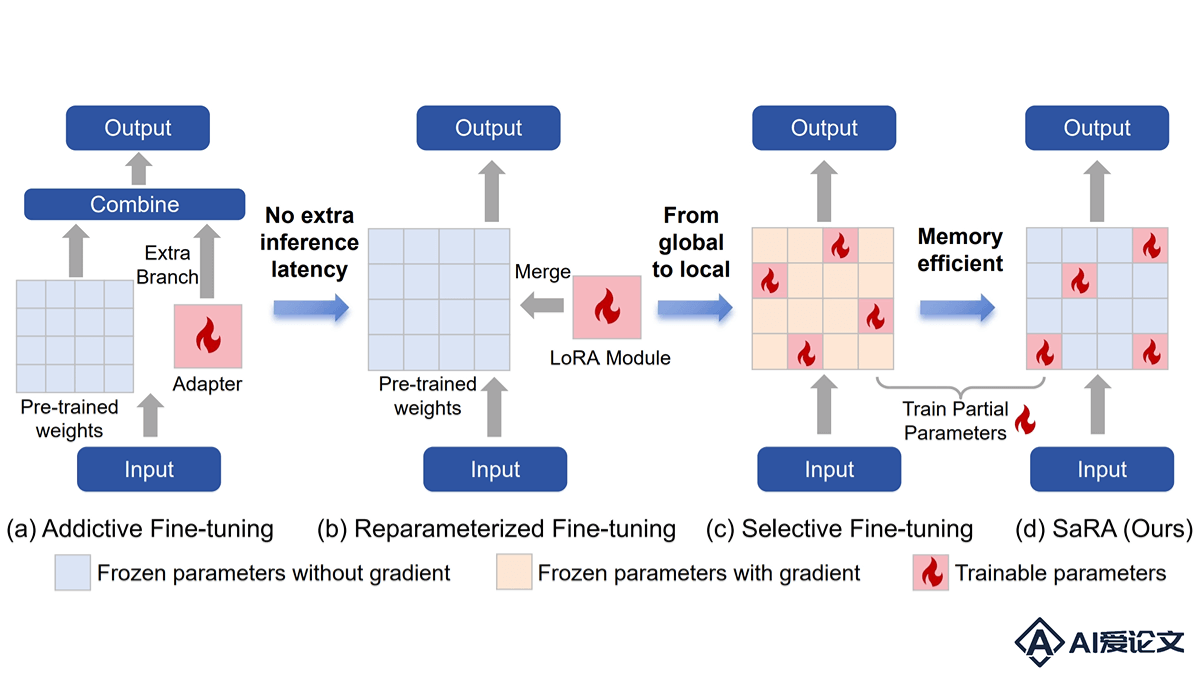

SaRA – 上海交大联合腾讯推出的预训练扩散模型微调方法

SaRA – 上海交大联合腾讯推出的预训练扩散模型微调方法SaRA是一种新型的预训练扩散模型微调方法,由上海交通大学和腾讯优图实验室共同推出。基于重新激活预训练过程中看似无效的参数,让模型能适应新任务。SaRA基于核范数低秩稀疏训练方案避免过拟合,引入渐进式参数调整策略,优化模型性能。

AI教程资讯

2025-02-18

2025-02-18

-

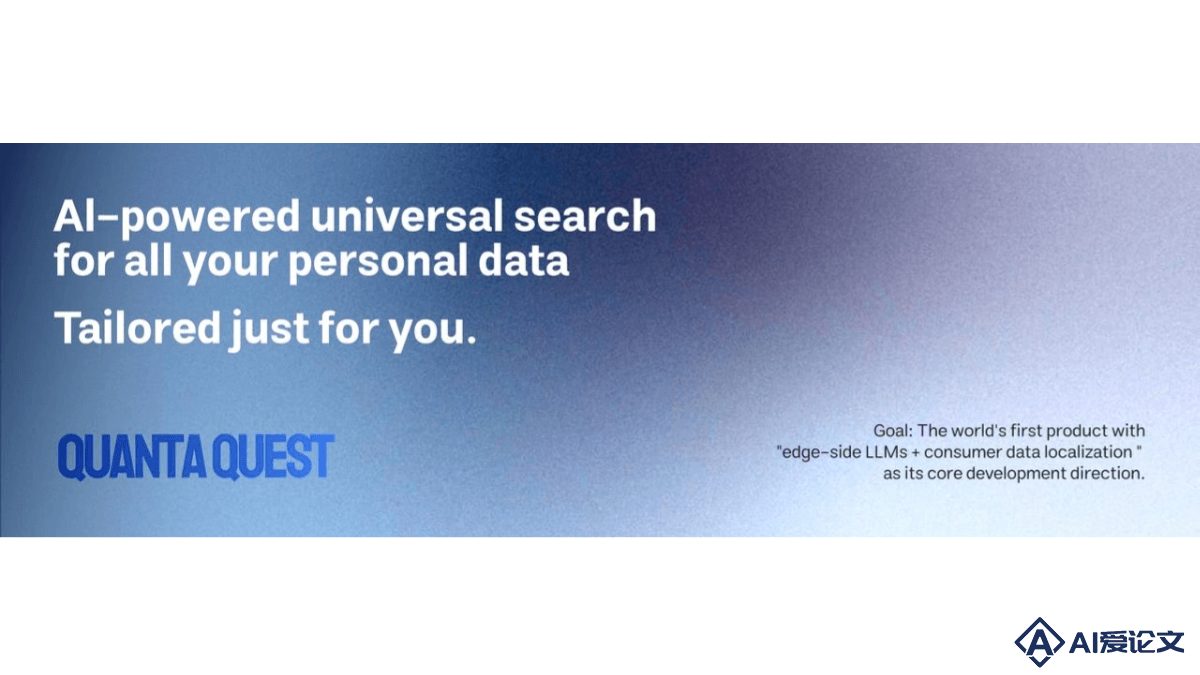

Quanta Quest – 开源的AI个人数据库产品,多平台数据整合

Quanta Quest – 开源的AI个人数据库产品,多平台数据整合Quanta Quest是一款面向个人用户的开源AI时代智能数据库产品,基于将个人数据如Gmail、Dropbox、Notion等整合到一个平台上,用RAG技术提供AI搜索功能,帮助用户高效管理和检索信息。Quanta Quest特别强调隐私保护和数据安全,确保用户数据的本地化处理,在保护个人隐私的同时,提供强大的数据检索能力。

AI教程资讯

2025-02-18

2025-02-18

-

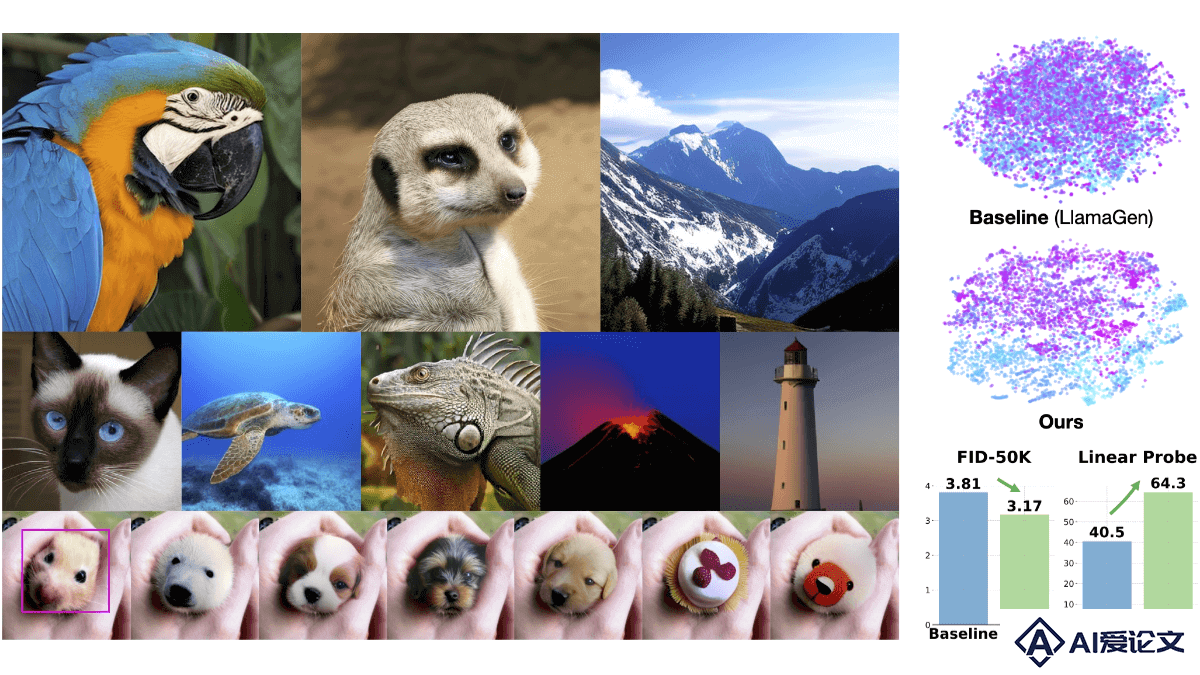

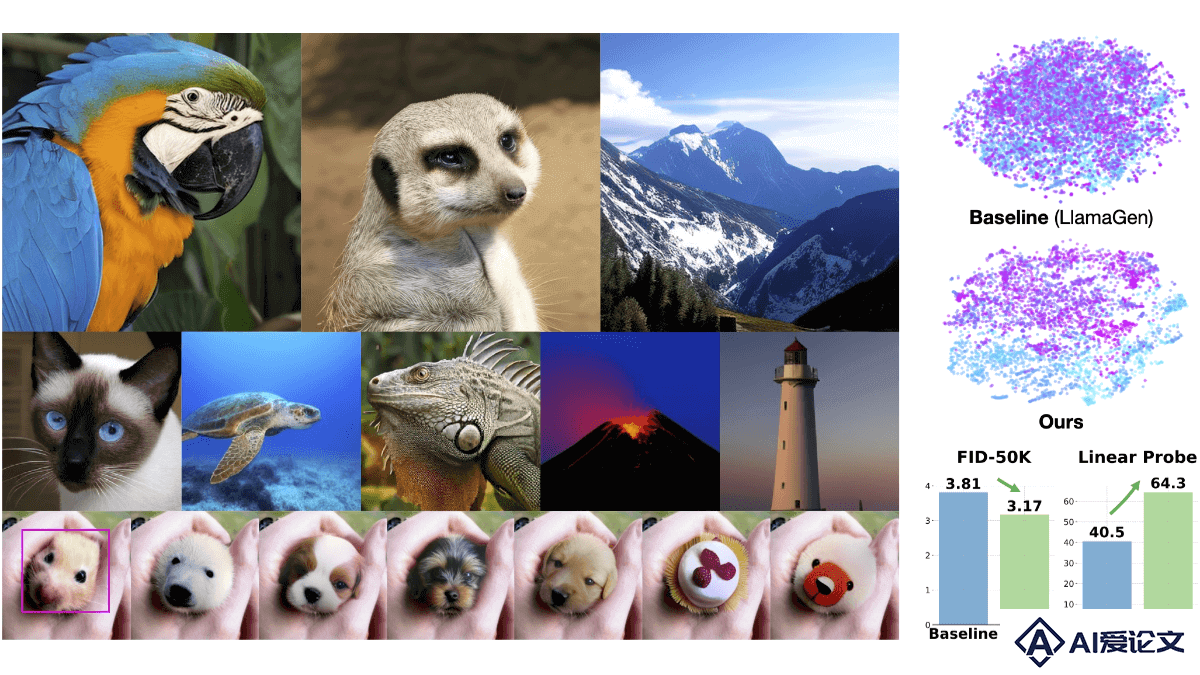

BiGR – 统一条件生成图像的模型框架,增强生成质量和表示能力

BiGR – 统一条件生成图像的模型框架,增强生成质量和表示能力BiGR是一种新型的条件图像生成模型,用紧凑的二进制潜在代码进行生成训练,增强图像的生成质量和表示能力。作为首个在同一框架内统一生成和判别任务的模型,BiGR在保持高生成质量的同时,能有效地执行视觉生成、辨别和编辑等多种视觉任务。

AI教程资讯

2025-02-18

2025-02-18

-

MoE++ – 昆仑万维和北大联合推出的混合专家架构

MoE++ – 昆仑万维和北大联合推出的混合专家架构MoE++是一种新型的混合专家(Mixture-of-Experts)架构,由昆仑万维2050研究院与北大袁粒团队联合推出。基于引入零计算量专家,即零专家、复制专家和常数专家,降低计算成本、提升模型性能。MoE++支持每个Token动态地与不同数量的前馈网络专家交互,甚至跳过某些层,优化计算资源分配。

AI教程资讯

2025-02-18

2025-02-18

最新录入

更多+

最新录入

更多+

同类别攻略

更多+

同类别攻略

更多+

- AnimePro FLUX – 动漫风格图像生成模型,基于Flux.1 Shnell模型微调 2025-02-10

- HK-O1aw – HKGAI团队联合北大团队推出的慢思考范式法律推理大模型 2025-02-10

- SeedEdit – 字节豆包团队推出的AI图像编辑模型 2025-02-10

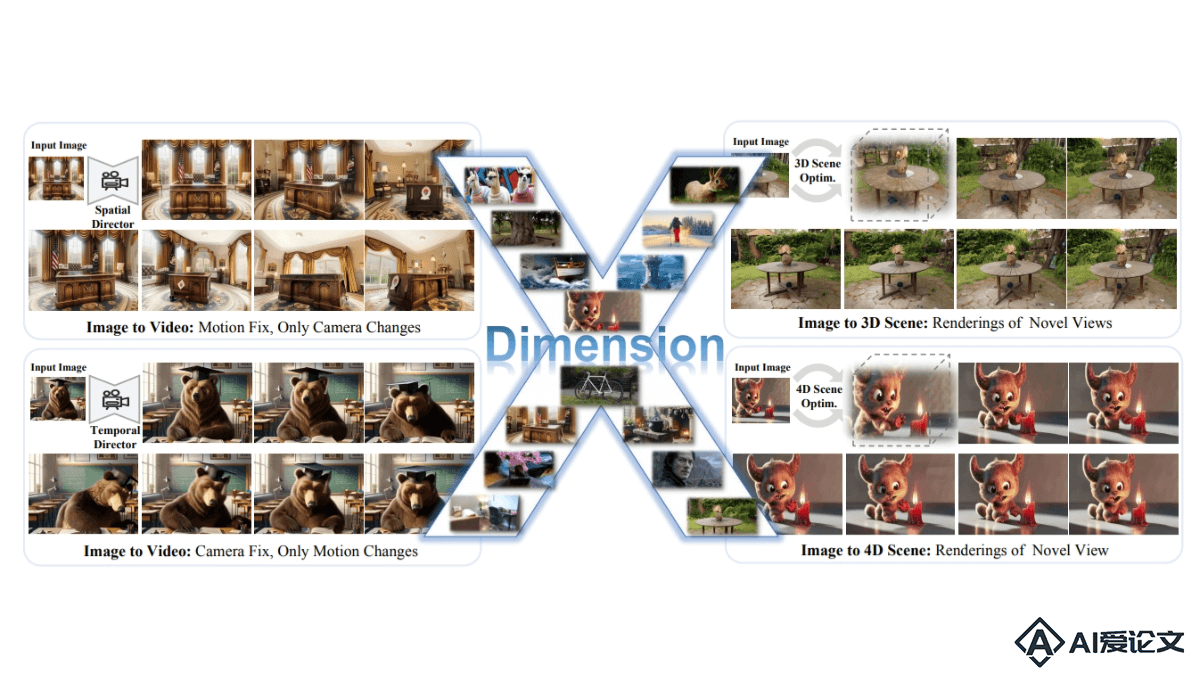

- DimensionX – 港科大、清华和生数科技共同推出的单图像生成复杂3D、4D场景框架 2025-02-10

- App Intents – 苹果推出的集成Siri和Apple Intelligence新框架 2025-02-10

- HourVideo – 李飞飞和吴佳俊团队推出的长视频理解基准数据集 2025-02-10

同类别推荐

更多+

同类别推荐

更多+

-

职得简历

查看

职得简历

查看

-

职徒简历

查看

职徒简历

查看

-

Timely

查看

Timely

查看

-

Raycast AI

查看

Raycast AI

查看

-

Merlin

查看

Merlin

查看

-

Monica

查看

Monica

查看

热门推荐

更多+

热门推荐

更多+

- SPAR3D – Stability AI等机构推出的单试图重建 3D 网络模型 01-13

- 星火纪要 – 科大讯飞推出的会议交流总结和分析平台 01-13

- Agent Laboratory – AMD 联合约翰·霍普金斯大学推出的自主科研 Agent 01-13

- 日日新融合大模型 – 商汤科技推出的原生融合模态大模型 01-13

- Search-o1 – 人大联合清华推出自主知识检索增强的推理框架 01-13

- LatentSync – 字节联合北交大开源的端到端唇形同步框架 01-15

- Diff-Instruct – 从预训练扩散模型中迁移知识的通用框架 01-20

- rStar-Math – 微软推出的小模型复杂推理与自进化SLMs的创新技术 01-13

- Mobile-Agent – 自主多模态移动设备代理,通过视觉感知实现智能化手机操作 01-14

- CHRONOS – 阿里通义联合上海交大等推出时间线摘要生成新框架 01-14

大家都在用

更多+

大家都在用

更多+

查看

查看

职徒简历

查看

职徒简历

查看

Timely

查看

Timely

查看

Raycast AI

查看

Raycast AI

查看

Merlin

查看

Merlin

查看

Monica

查看

Monica

查看