通古大模型是什么

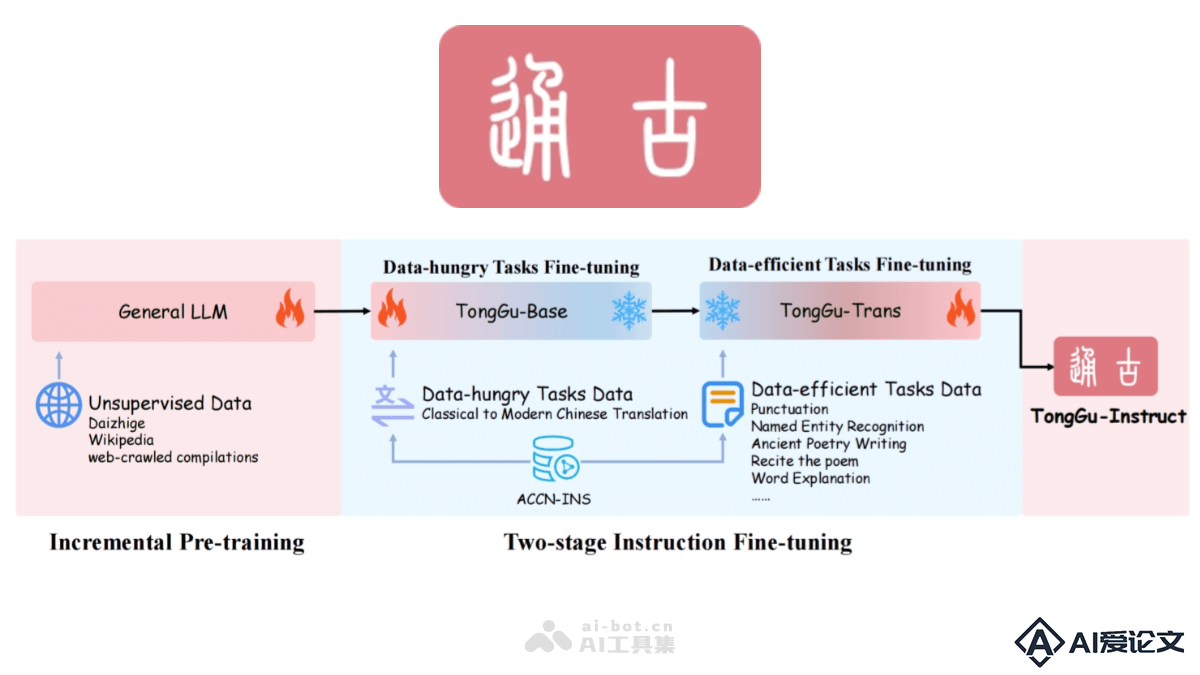

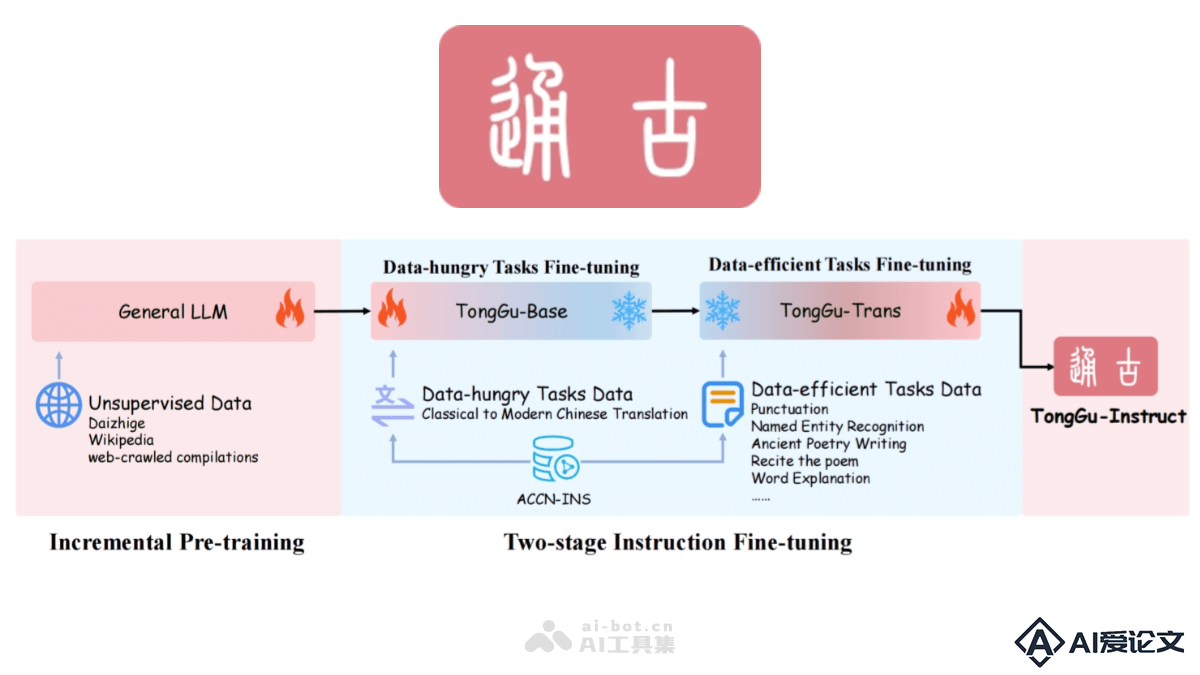

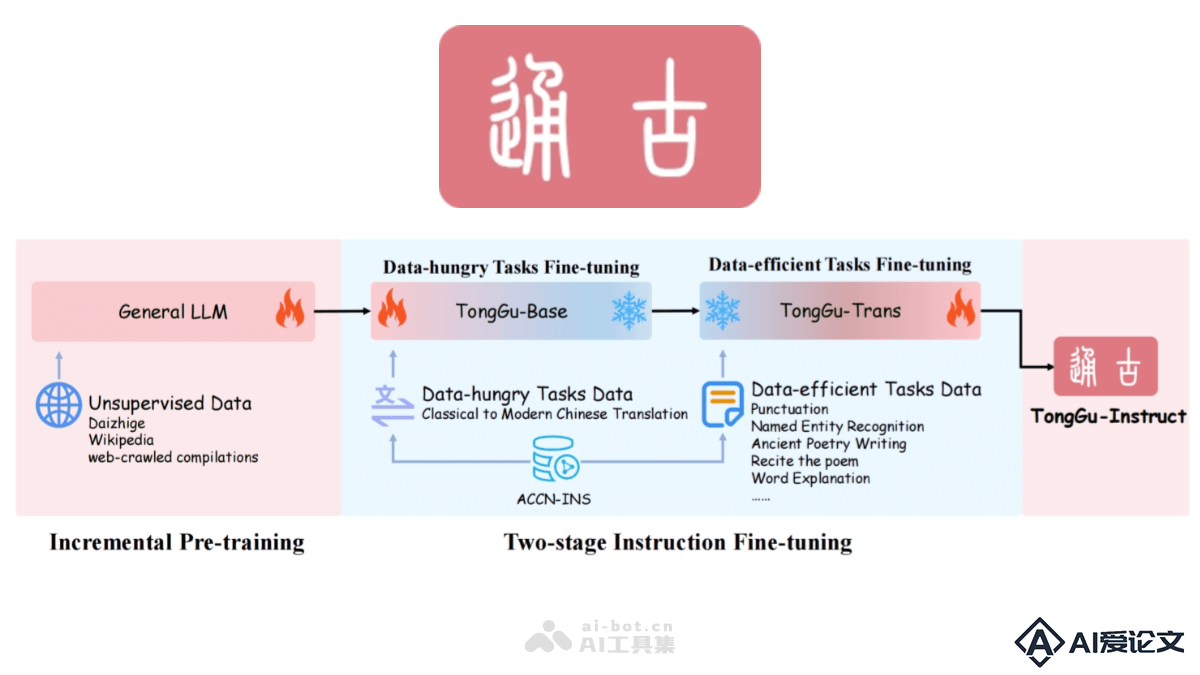

通古大模型是华南理工大学深度学习与视觉计算实验室(SCUT-DLVCLab)推出的专注于古籍文言文处理的人工智能语言模型。基于百川2-7B-Base进行增量预训练,使用24.1亿古籍语料进行无监督训练,结合400万古籍对话数据进行指令微调。模型采用冗余度感知微调(RAT)技术,有效提升了古籍任务的性能。帮助用户更便捷地理解和翻译古籍文献。通过检索增强生成(CCU-RAG)技术,减少知识密集型任务中的幻觉问题,提高生成内容的准确性和可靠性。

来源:爱论文 时间:2025-03-19 12:28:16

通古大模型是华南理工大学深度学习与视觉计算实验室(SCUT-DLVCLab)推出的专注于古籍文言文处理的人工智能语言模型。基于百川2-7B-Base进行增量预训练,使用24.1亿古籍语料进行无监督训练,结合400万古籍对话数据进行指令微调。模型采用冗余度感知微调(RAT)技术,有效提升了古籍任务的性能。帮助用户更便捷地理解和翻译古籍文献。通过检索增强生成(CCU-RAG)技术,减少知识密集型任务中的幻觉问题,提高生成内容的准确性和可靠性。

相关资讯

更多+

相关资讯

更多+

通古大模型是华南理工大学深度学习与视觉计算实验室(SCUT-DLVCLab)推出的专注于古籍文言文处理的人工智能语言模型。基于百川2-7B-Base进行增量预训练,使用24 1亿古籍语料进行无监督训练,结合400万古籍对话数据进行指令微调。

AI教程资讯

2023-04-14

2023-04-14

ENEL(Exploring the Potential of Encoder-free Architectures in 3D LMMs)是创新的无编码器3D大型多模态模型(3D LMM),解决传统编码器架构在3D理解任务中的局限性。ENEL通过去除3D编码器,直接将点云数据转换为离散的点标记,与文本标记拼接后输入到大型语言模型(LLM)中。

AI教程资讯

2023-04-14

2023-04-14

AnyCharV 是香港中文大学、清华大学深圳国际研究生院、香港大学联合推出的角色可控视频生成框架,能将任意参考角色图像与目标驱动视频相结合,生成高质量的角色视频。AnyCharV基于两阶段训练策略实现精细到粗略的引导:第一阶段用细粒度分割掩码和姿态信息进行自监督合成;第二阶段用自增强训练和粗粒度掩码优化角色细节保留。

AI教程资讯

2023-04-14

2023-04-14

NobodyWho是为 Godot 游戏引擎设计的插件,通过本地运行的大型语言模型(LLM)实现互动小说创作。支持 Windows、Linux 和 macOS 平台,用户无需联网即可使用高性能的 LLM 功能,如对话交互和文本生成。

AI教程资讯

2023-04-14

2023-04-14

热门推荐

更多+

热门推荐

更多+