OmniEdit – 滑铁卢大学等机构开源的通用图像编辑模型

来源:爱论文

时间:2025-02-04 00:13:09

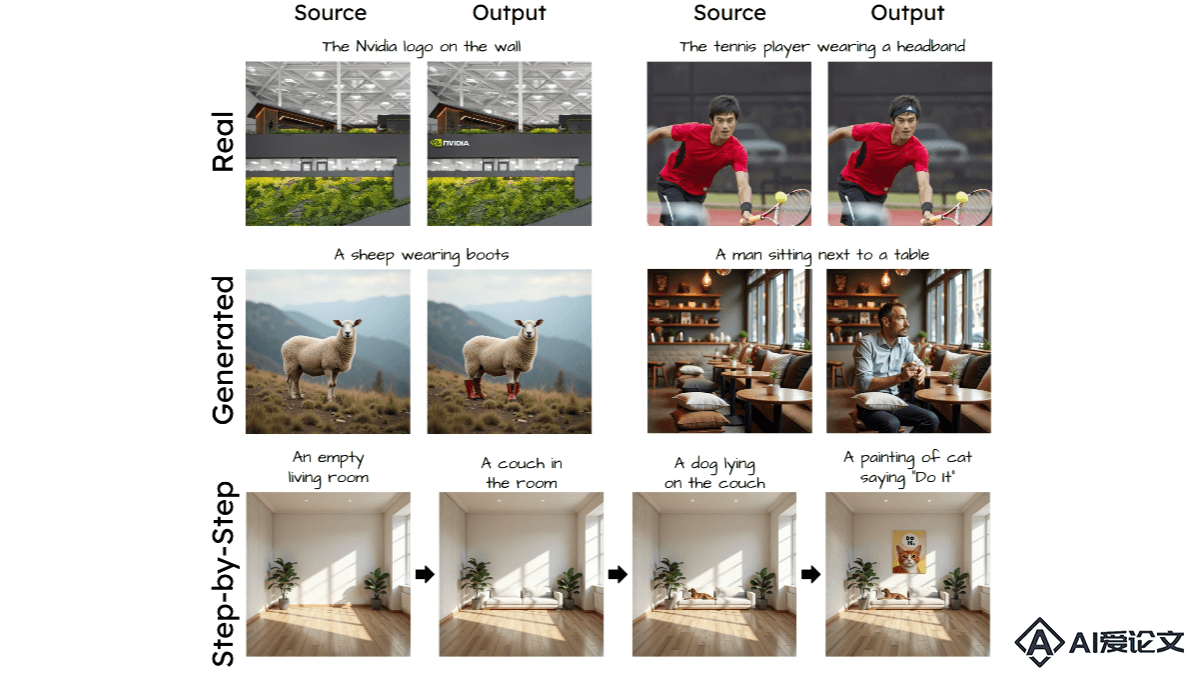

OmniEdit是什么

OmniEdit是先进的图像编辑技术,通过结合多个专家模型的监督来训练一个通用模型,处理多种图像编辑任务。能处理不同纵横比的图像,七种不同的图像编辑任务,包括对象替换、移除、添加等,支持任意宽高比和分辨率。基于七个专家模型的监督训练确保任务覆盖,用在大型多模态模型评分提高训练数据质量,采用EditNet的新架构,提高了编辑的成功率。OmniEdit在自动评估和人工评估中均显著优于现有模型(包括InstructPix2Pix、MagicBrush、UltraEdi等),能准确遵循指令,同时保持原始图像的保真度。

OmniEdit的主要功能

多任务编辑能力:OmniEdit能执行七种不同的图像编辑任务,包括对象替换、对象移除、对象添加、属性修改、背景替换、环境变化和风格转换。专家模型监督:OmniEdit 基于七个不同专家模型的监督来训练,确保任务覆盖。任意宽高比和分辨率支持:模型能处理不同宽高比和分辨率的图像,适用于各种实际场景。指令驱动的编辑:用户基于文本指令指导OmniEdit进行特定的图像编辑,提高编辑的灵活性和用户控制能力。高质量图像输出:在编辑过程中,OmniEdit能保持原始图像的高保真度,减少噪声和伪影。数据质量控制:用大型多模态模型对合成样本进行评分,提高训练数据的质量。

OmniEdit的技术原理

专家到通用模型的监督学习:多个专家模型的监督信号训练一个通用编辑模型,每个专家模型专注于特定的编辑任务。重要性采样:大型多模态模型(如GPT-4o)对合成样本进行质量评分,进行重要性采样,提高训练数据集的质量。EditNet架构:基于扩散-变换器的架构,用中间表示的交互,支持控制分支和原始分支之间的交互,增强模型对编辑任务的理解。支持任意宽高比:在训练过程中,包含不同宽高比的图像,确保模型能够适应任何图像的宽高比。

OmniEdit的项目地址

GitHub仓库:https://github.com/TIGER-AI-Lab/OmniEditHuggingFace模型库:https://huggingface.co/collections/TIGER-Lab/omniedit-6732d8e381c3e56b0a2106d5arXiv技术论文:https://arxiv.org/pdf/2411.07199

OmniEdit的应用场景

专业图像编辑:设计师和艺术家进行高效的图像编辑工作,包括广告设计、艺术创作、照片修复等。社交媒体内容创作:社交媒体用户快速编辑和美化图片,增加内容的吸引力。电子商务:在线商家编辑产品图片,如更换背景、调整风格,提高产品的市场吸引力。新闻和媒体:新闻机构快速调整新闻图片,适应不同的出版需求和风格。教育和培训:在教育领域,作为教学工具,帮助学生学习图像编辑和视觉设计。

相关资讯

相关资讯 2023-04-14

2023-04-14

下载

下载