GLM-Edge – 智谱开源的端侧大语言和多模态系列模型

来源:爱论文

时间:2025-01-31 12:44:30

GLM-Edge是什么

GLM-Edge是智谱开源的一系列端侧部署优化的大语言对话模型和多模态理解模型,包含GLM-Edge-1.5B-Chat、GLM-Edge-4B-Chat、GLM-Edge-V-2B和GLM-Edge-V-5B。1.5B / 2B模型主要面向手机、车机等平台、4B / 5B 模型主要面向PC等平台。基于GLM-4系列技术积累,调整模型结构和尺寸,实现模型性能、实机推理效果和落地便利性之间的最佳平衡。在高通骁龙8 Elite等端侧平台上,GLM-Edge基于混合量化方案和投机采样技术,1.5B对话模型、2B多模态模型能实现每秒60至100个tokens的高速解码,展现出卓越的推理性能。

GLM-Edge的主要功能

大语言对话模型:提供基于大型语言模型的对话能力,理解和生成自然语言,适用于聊天机器人、智能助手等应用。多模态理解模型:结合视觉和语言信息,理解和描述图片内容,适用于图像标注、视觉问答等多模态交互场景。端侧优化:针对手机、车机和PC等端侧设备进行优化,实现在资源受限的环境中高效运行。快速推理:在特定硬件平台上,如高通骁龙8 Elite,基于混合量化和投机采样技术,实现高速的模型推理。跨平台部署:支持在多种硬件和操作系统上部署,包括但不限于Android、iOS和Windows。

GLM-Edge的技术原理

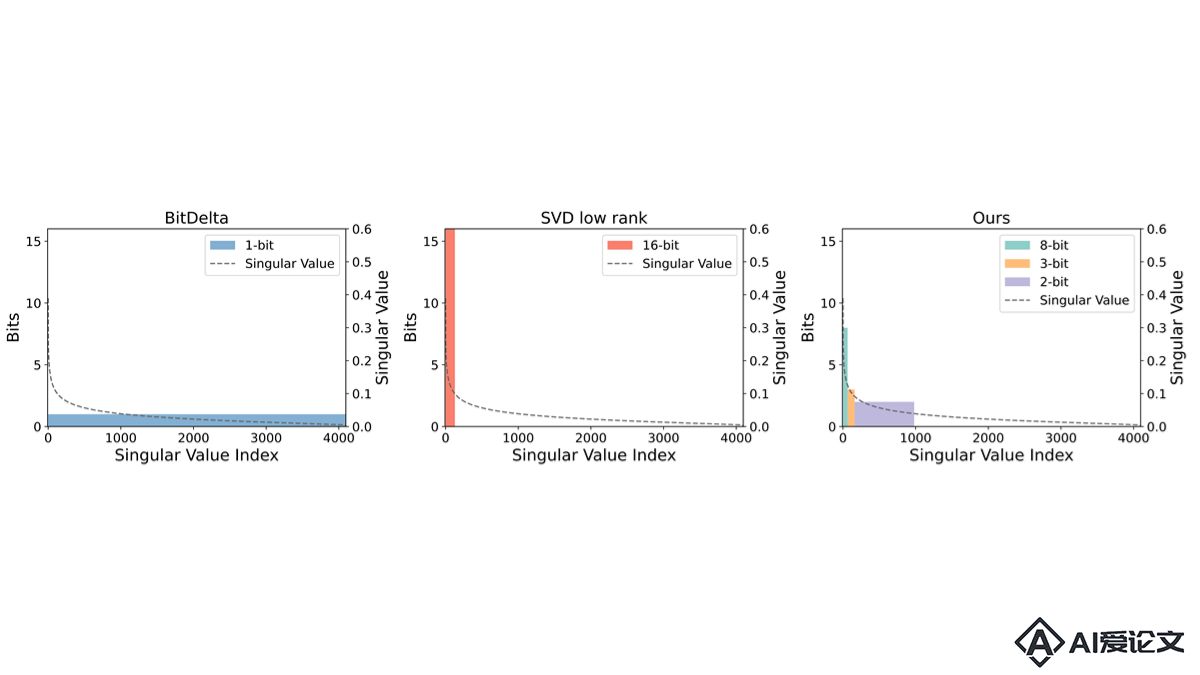

预训练语言模型:GLM-Edge系列模型基于自回归语言模型,在大规模文本数据上进行预训练,学习语言的复杂结构和语义信息。迁移学习:预训练完成后,模型基于迁移学习适应特定的下游任务,如对话生成、文本分类等。量化技术:为在端侧设备上高效运行,GLM-Edge采用量化技术,将模型的权重和激活从浮点数转换为低精度表示,如INT4或INT8,减少模型大小和计算需求。混合量化方案:结合不同的量化策略,如动态量化和静态量化,平衡模型性能和推理速度。投机采样技术:预测性地执行计算,减少实际需要的计算量,提高模型的推理速度。

GLM-Edge的项目地址

GitHub仓库:https://github.com/THUDM/GLM-EdgeHuggingFace模型库:GLM-Edge-1.5B-Chat:https://huggingface.co/THUDM/glm-edge-1.5b-chatGLM-Edge-4B-Chat:https://huggingface.co/THUDM/glm-edge-4b-chatGLM-Edge-V-2B:https://huggingface.co/THUDM/glm-edge-v-2bGLM-Edge-V-5B:https://huggingface.co/THUDM/glm-edge-v-5b在线体验Demo:GLM-Edge-1.5B-Chat:https://huggingface.co/spaces/THUDM-HF-SPACE/GLM-Edge-1.5B-Chat-SpaceGLM-Edge-V-5B:https://huggingface.co/spaces/THUDM-HF-SPACE/GLM-Edge-V-5B-Space

GLM-Edge的应用场景

智能助手和聊天机器人:提供自然语言交互,帮助用户解决问题,执行任务。语音识别和语音助手:集成到智能音箱、车载系统等设备中,提供语音控制功能。客户服务:用于自动回复客户咨询,提供客户支持,减少客服工作量。教育和学习:作为语言学习工具,帮助学生练习语言和理解复杂概念。内容创作和编辑:辅助写作,生成文章、报告等内容,提高创作效率。

相关资讯

相关资讯 2023-04-14

2023-04-14

下载

下载