Instella – AMD开源的30亿参数系列语言模型

来源:爱论文

时间:2025-04-20 15:49:57

Instella是什么

Instella是AMD推出的系列30亿参数的开源语言模型。模型完全从零开始在AMD Instinct™ MI300X GPU上训练而成,基于自回归Transformer架构,包含36个解码器层和32个注意力头,支持最长4096个标记的序列。Instella经过多阶段训练,包括大规模预训练、监督微调和偏好优化,提升自然语言理解、指令跟随和对话能力。Instella在多个基准测试中超越现有的开源模型,与最先进的开源权重模型具有竞争力。AMD完全开源Instella的模型权重、训练配置、数据集和代码,促进AI社区的合作与创新。

Instella的主要功能

自然语言理解:理解复杂的自然语言文本,处理各种语言任务,如问答、文本生成和语义分析。指令跟随:基于监督微调(SFT)和直接偏好优化(DPO),准确理解和执行用户指令,生成符合人类偏好的回答。多轮对话能力:支持多轮交互,根据上下文进行连贯的对话。问题解决能力:在数学问题、逻辑推理和知识问答等任务上表现出色。多领域适应性:基于多样化的训练数据,适应多种领域,如学术、编程、数学和日常对话等。

Instella的技术原理

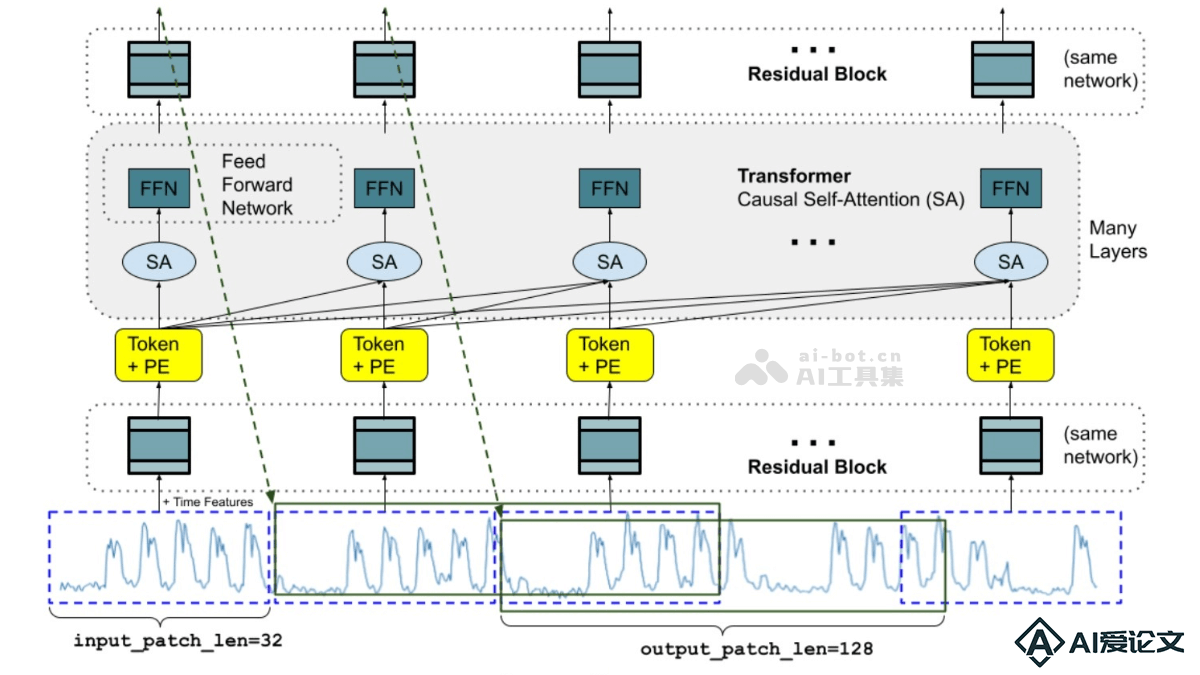

Transformer架构:基于自回归Transformer架构,包含36个解码器层,每层有32个注意力头,支持最长4096个标记的序列长度。高效训练技术:FlashAttention-2、Torch Compile和bfloat16混合精度训练,优化内存使用和计算效率。多阶段训练:用4.065万亿标记进行大规模预训练,建立基础语言理解能力。在第一阶段基础上进一步训练,使用额外的575.75亿标记,增强特定任务能力。监督微调(SFT):用高质量的指令-响应对数据进行微调,提升指令跟随能力。直接偏好优化(DPO):基于人类偏好数据对模型进行优化,让输出更符合人类价值观。分布式训练:基于完全分片数据并行(FSDP)技术,将模型参数、梯度和优化器状态在节点内分片,在节点间复制,实现大规模集群训练。数据集:基于多样化的高质量数据集进行训练,包括学术、编程、数学和对话数据,及合成数据集,确保模型具备广泛的知识和能力。

Instella的项目地址

项目官网:https://rocm.blogs.amd.com/artificial-intelligence/introducing-instellaGitHub仓库:https://github.com/AMD-AIG-AIMA/InstellaHuggingFace模型库:https://huggingface.co/collections/amd/instella

Instella的应用场景

智能客服:自动回答问题,提供个性化服务,提升客户体验。内容创作:生成文案、故事等,辅助内容创作者提高效率。教育辅导:解答学术问题,提供学习建议,辅助学生学习。编程辅助:生成代码片段,提供编程建议,帮助开发者解决问题。企业知识管理:整合公司知识,提供内部咨询,提升协作效率。

相关资讯

相关资讯 2023-04-14

2023-04-14

下载

下载