Open-Sora 2.0是什么

Open-Sora 2.0 是潞晨科技推出的全新开源SOTA(State-of-the-Art)视频生成模型。Open-Sora 2.0 用 20 万美元(224 张 GPU)成功训练出 11B 参数的商业级模型,相比传统高性能视频生成模型大幅降低了训练成本。模型在 VBench 和用户偏好测试中表现卓越,性能媲美甚至超越 HunyuanVideo 和 30B 参数的 Step-Video 等主流闭源模型。Open-Sora 2.0 基于 3D 自编码器、3D 全注意力机制和 MMDiT 架构,结合高效的并行训练方案和高压缩比自编码器,显著提升训练效率和推理速度。

Open-Sora 2.0的主要功能

高质量视频生成:生成 720p 分辨率、24 FPS 的流畅视频,支持多种场景和风格,从自然风光到复杂动态场景都能表现出色。动作幅度可控:根据用户需求调整视频中人物或物体的动作幅度,实现更细腻、精准的动态表现。文本到视频(T2V)生成:支持用文本描述直接生成对应的视频内容,满足创意视频制作和内容生成的需求。图像到视频(I2V)生成:结合开源图像模型,基于图像生成视频,进一步提升生成效果和多样性。Open-Sora 2.0的技术原理

模型架构:基于三维自编码器高效处理视频数据,捕捉时间维度上的动态信息。引入全注意力机制,提升视频生成的时空一致性。结合多模态扩散(MMDiT)架构,更精准地捕捉文本与视频内容的关联。高压缩比自编码器:基于 4×32×32 的高压缩比自编码器,显著降低推理成本。高效训练方法:基于多阶段、多层次的数据筛选机制,确保高质量数据输入,提升训练效率。优先在低分辨率下训练,学习关键动态特征,逐步提升分辨率,大幅降低计算开销。优先训练图生视频任务,用图像特征引导视频生成,加速模型收敛。并行训练与优化:结合 ColossalAI 和系统级优化,提升计算资源利用率。关键技术优化包括序列并行、ZeroDP、细粒度 Gradient Checkpointing、自动恢复机制、高效数据加载与内存管理等,确保训练效率最大化。模型初始化与蒸馏:借助开源图生视频模型 FLUX 进行初始化,降低训练成本。基于蒸馏的优化策略提升自编码器特征空间的表达能力,减少训练所需数据量和时间。Open-Sora 2.0的性能表现

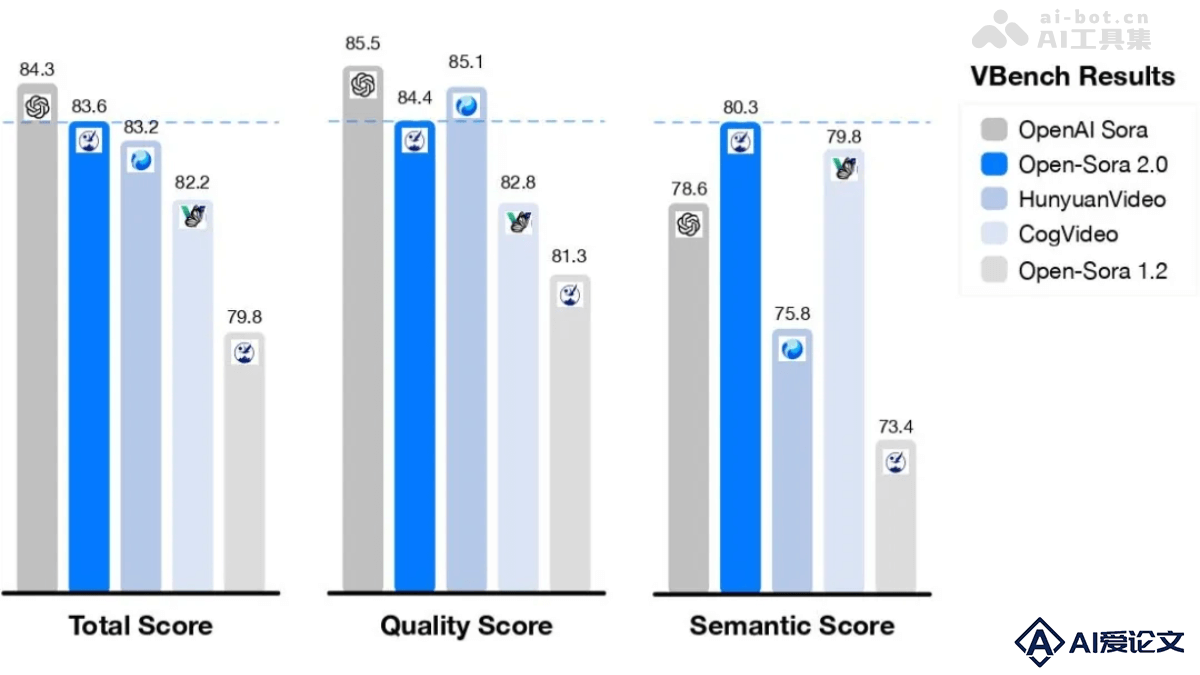

媲美 HunyuanVideo 和 30B Step-Video:Open-Sora 2.0 凭借仅 11B 参数规模,在 VBench 和人工偏好测试中达到与高成本开发的主流闭源大模型(如 HunyuanVideo 和 30B 参数的 Step-Video)相媲美的水平。用户偏好评测:在视觉表现、文本一致性和动作表现三大关键维度中,Open-Sora 2.0 至少在两个指标上超越开源 SOTA 模型 HunyuanVideo 和商业模型 Runway Gen-3 Alpha,用更少的资源实现更优的性能表现。VBench 指标表现强势:根据视频生成权威榜单 VBench 的评测结果,Open-Sora 2.0 的性能表现极为出色。从Open-Sora 1.2升级到2.0版本后,与行业领先的 OpenAI Sora 闭源模型之间的性能差距从 4.52% 缩减至仅 0.69%,几乎实现完全的性能对齐。Open-Sora 2.0 的评测分数已超越腾讯的 HunyuanVideo,用更低的训练成本达成了更高的性能水平,为开源视频生成领域树立新的里程碑。

Open-Sora 2.0的项目地址

GitHub仓库:https://github.com/hpcaitech/Open-Sora技术论文:https://github.com/hpcaitech/Open-Sora-Demo/blob/main/paper/Open_Sora_2Open-Sora 2.0的生成效果

提示词:A tomato surfing on a piece of lettuce down a waterfall of ranch dressing, with exaggerated surfing moves and creamy wave effects to highlight the 3D animated fun.(一颗番茄在一片生菜上冲浪,顺着牧场酱汁的瀑布而下,夸张的冲浪动作和柔滑的波浪效果凸显了 3D 动画的乐趣。) 提示词:A drone camera circles a historic church on a rocky outcrop along the Amalfi Coast, highlighting its stunning architecture, tiered patios, and the dramatic coastal views with waves crashing below and people enjoying the scene in the warm afternoon light.(一架无人机摄像机围绕着阿马尔菲海岸岩石露头上的一座历史悠久的教堂飞行,突显了其令人惊叹的建筑、分层的庭院和壮观的海岸景色,海浪拍打在教堂下方,人们在温暖的午后阳光下欣赏着这美丽的景色。)

提示词:A drone camera circles a historic church on a rocky outcrop along the Amalfi Coast, highlighting its stunning architecture, tiered patios, and the dramatic coastal views with waves crashing below and people enjoying the scene in the warm afternoon light.(一架无人机摄像机围绕着阿马尔菲海岸岩石露头上的一座历史悠久的教堂飞行,突显了其令人惊叹的建筑、分层的庭院和壮观的海岸景色,海浪拍打在教堂下方,人们在温暖的午后阳光下欣赏着这美丽的景色。) 提示词:A scene from disaster movie.(灾难片中的场景。)

提示词:A scene from disaster movie.(灾难片中的场景。) 提示词:Chinese ancient style, realism. A young woman, dressed in an embroidered red qipao, walks along the ancient streets of a bustling Chinese town. The red lanterns hanging above her sway gently in the evening breeze, and her calm, confident stride contrasts with the lively atmosphere of merchants and performers around her.(中国古风写实。一位身着绣花红旗袍的年轻女子走在繁华的中国小镇的古老街道上。头顶上悬挂的红灯笼在晚风中轻轻摇曳,她从容自信的步伐与周围商贩和艺人的热闹氛围形成鲜明对比。)

提示词:Chinese ancient style, realism. A young woman, dressed in an embroidered red qipao, walks along the ancient streets of a bustling Chinese town. The red lanterns hanging above her sway gently in the evening breeze, and her calm, confident stride contrasts with the lively atmosphere of merchants and performers around her.(中国古风写实。一位身着绣花红旗袍的年轻女子走在繁华的中国小镇的古老街道上。头顶上悬挂的红灯笼在晚风中轻轻摇曳,她从容自信的步伐与周围商贩和艺人的热闹氛围形成鲜明对比。)

相关资讯

相关资讯 2023-04-14

2023-04-14

下载

下载