OmAgent – Om AI联合浙大开源的多模态语言代理框架

来源:爱论文

时间:2025-03-28 11:53:44

OmAgent是什么

OmAgent是Om AI和浙江大学滨江研究院联合开源的多模态语言代理框架,能简化设备端智能代理的开发。OmAgent支持可重用的代理组件,助力开发者构建复杂的多模态代理,处理文本、图像、视频和音频等多种输入形式。OmAgent赋能各种硬件设备,如智能手机、智能可穿戴设备、IP摄像头等,基于抽象不同设备类型,简化连接到先进多模态模型和算法的过程。OmAgent优化了计算流程,提供实时交互体验,具备易连接多样设备、集成前沿多模态模型、支持复杂问题解决算法等关键特点,提供直观的接口构建可扩展的代理,适应各种应用需求。

OmAgent的主要功能

多设备连接:OmAgent让连接物理设备变得非常简单,比如手机、眼镜等,能构建直接在设备上运行的应用,提供智能手机应用和对应的后端,用户无需担心复杂的设备连接问题,可以专注于代理功能的开发。高效模型集成:集成SOTA模型,整合最先进的商业和开源基础模型,为应用开发者提供了最强大的智能支持。提供算法实现接口:为研究人员和开发者提供易于使用的流程编排接口,方便他们实现最新的代理算法,如ReAct、DnC等。让OmAgent能够支持更复杂的任务和问题解决,拓展代理的功能边界。

OmAgent的技术原理

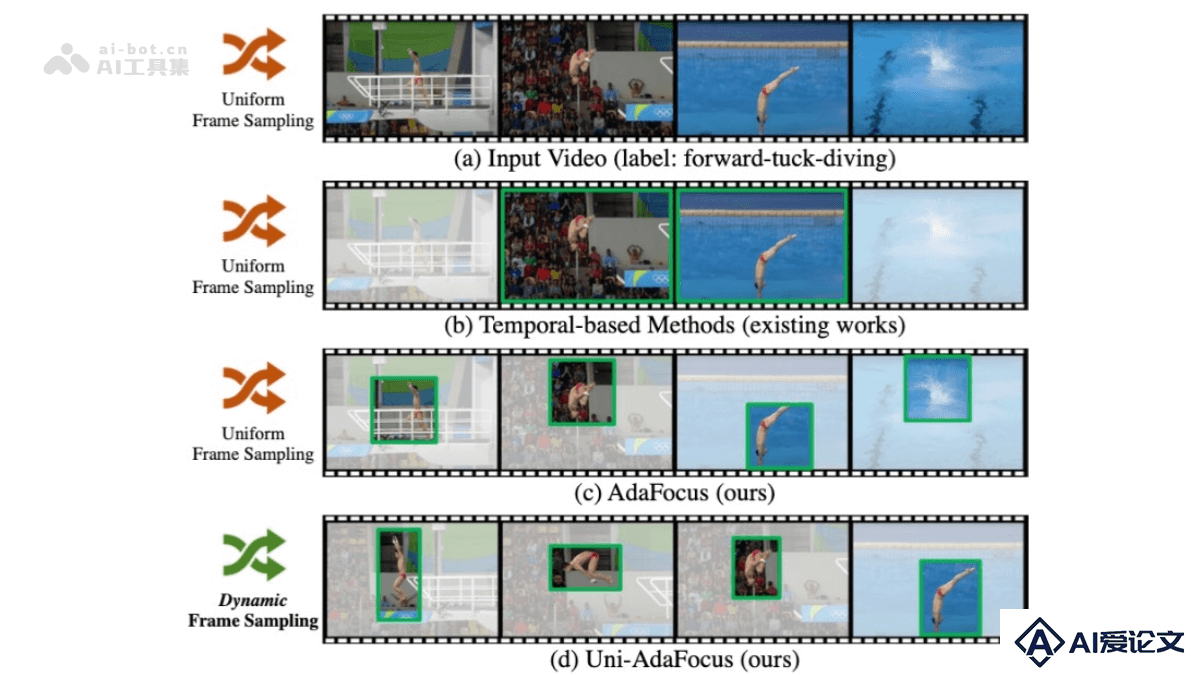

视频预处理与存储:场景检测:将视频分割成独立的视频块,记录每个块的开始和结束时间戳,并从中均匀采样帧。视觉提示:用面部识别等算法标注视频帧,提供额外的视觉信息。音频文本表示:基于ASR算法将视频中的语音转换为文本,并区分不同的说话者。场景描述:用MLLMs生成每个视频段的详细描述,包括时间、地点、人物、事件等信息。编码和存储:将生成的场景描述向量化并存储在知识数据库中,同时保存原始文本和时间戳信息。分治循环(DnC Loop):任务分解:将复杂任务递归分解为可执行的子任务,直到子任务足够简单直接处理。工具调用:在处理过程中,根据需要调用外部工具(如视频回放工具“rewinder”)补充信息,解决信息丢失问题。任务执行:基于递归树结构存储任务执行路径,确保任务的顺利执行和结果的合并。工具调用机制:自主调用:根据任务信息自主生成工具调用请求参数,调用外部工具(如互联网搜索、面部识别、文件处理等)完成复杂任务。视频回放工具:特别提供“rewinder”工具,在需要时回放特定时间段的视频,提取详细信息。查询处理与检索:时间戳提取:从查询中提取时间信息,用在过滤检索结果。文本编码与检索:将查询文本编码为嵌入向量,用在从知识数据库中检索相关的视频段信息。任务传递:将检索到的视频段信息和原始任务传递给DnC Loop进行处理。结果合成与输出:子任务执行:DnC Loop递归执行子任务,处理复杂任务,在必要时调用工具补充信息。结果合成:将所有子任务的执行结果合成最终答案,基于专门的节点输出最终结果。

OmAgent的项目官网

项目官网:https://www.om-agent.com/GitHub仓库:https://github.com/om-ai-lab/OmAgentarXiv技术论文:https://arxiv.org/pdf/2406.16620

OmAgent的应用场景

视频监控:实时分析监控视频,检测异常事件并发出警报,提高安全性和响应速度。内容推荐:为用户推荐个性化视频内容,结合多模态信息提供更全面的推荐。教育:解析教育视频,生成总结和笔记,通过互动学习提升用户体验。娱乐与影视:分析影视内容,提供剧情总结和角色介绍,增强观众的观影体验。智能客服与支持:通过自然语言查询视频内容,提供详细答案和多模态交互服务。

相关资讯

相关资讯 2023-04-14

2023-04-14

下载

下载