EmoLLM是什么

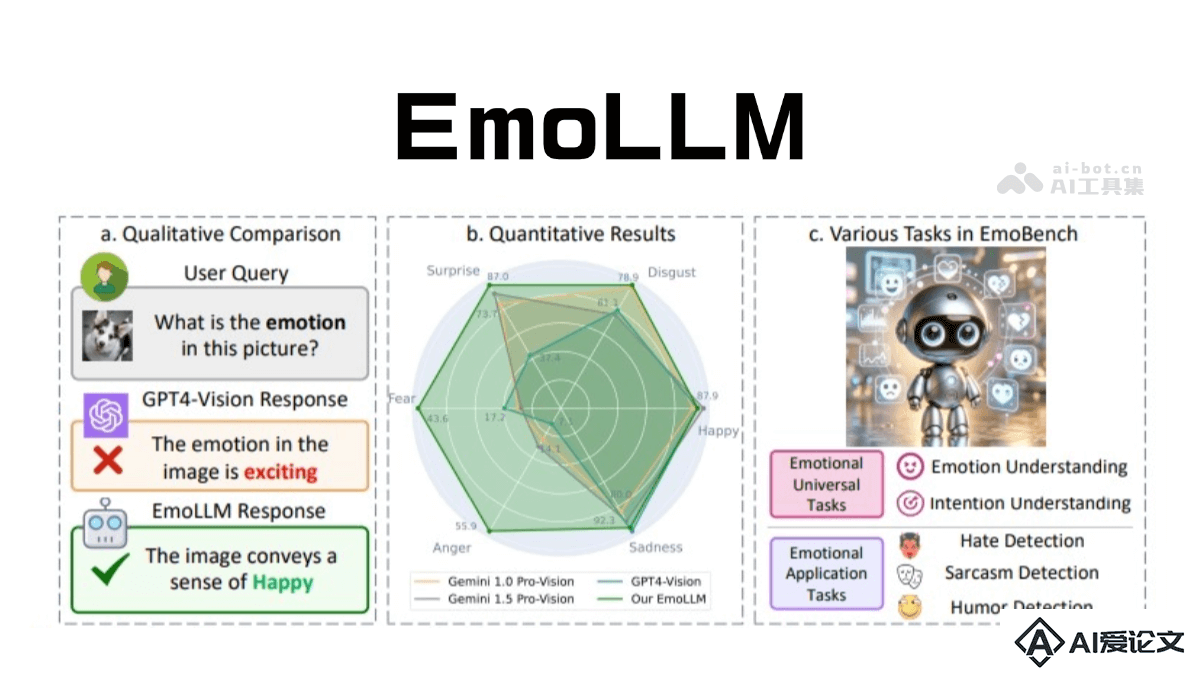

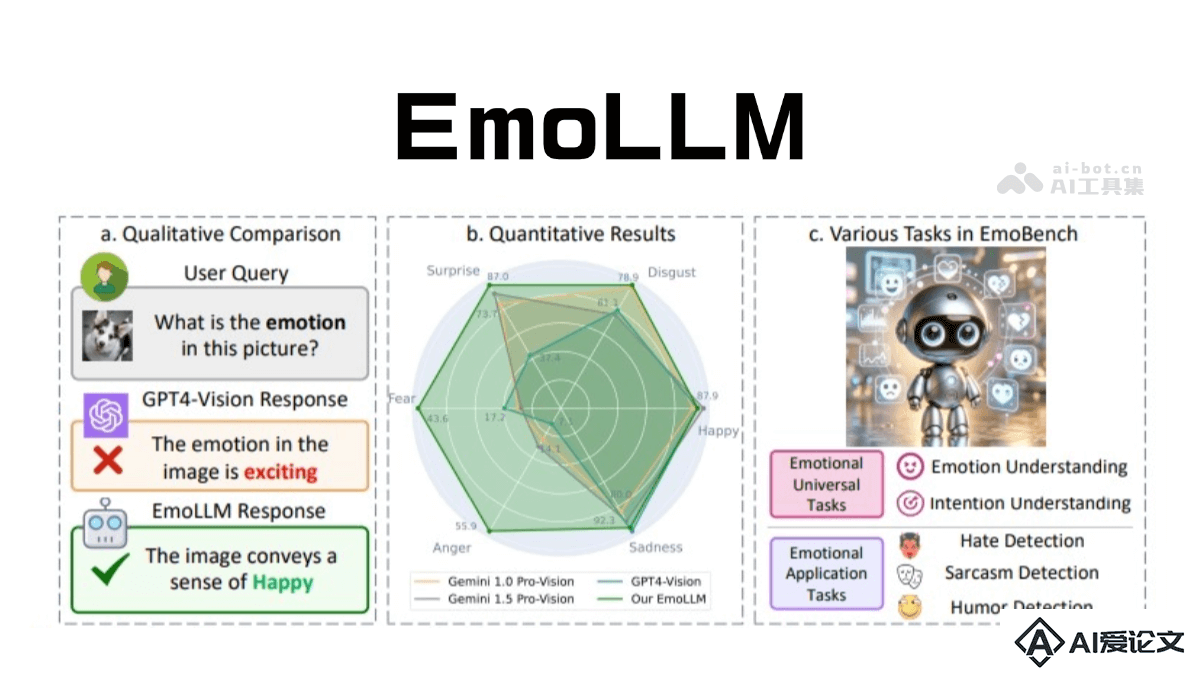

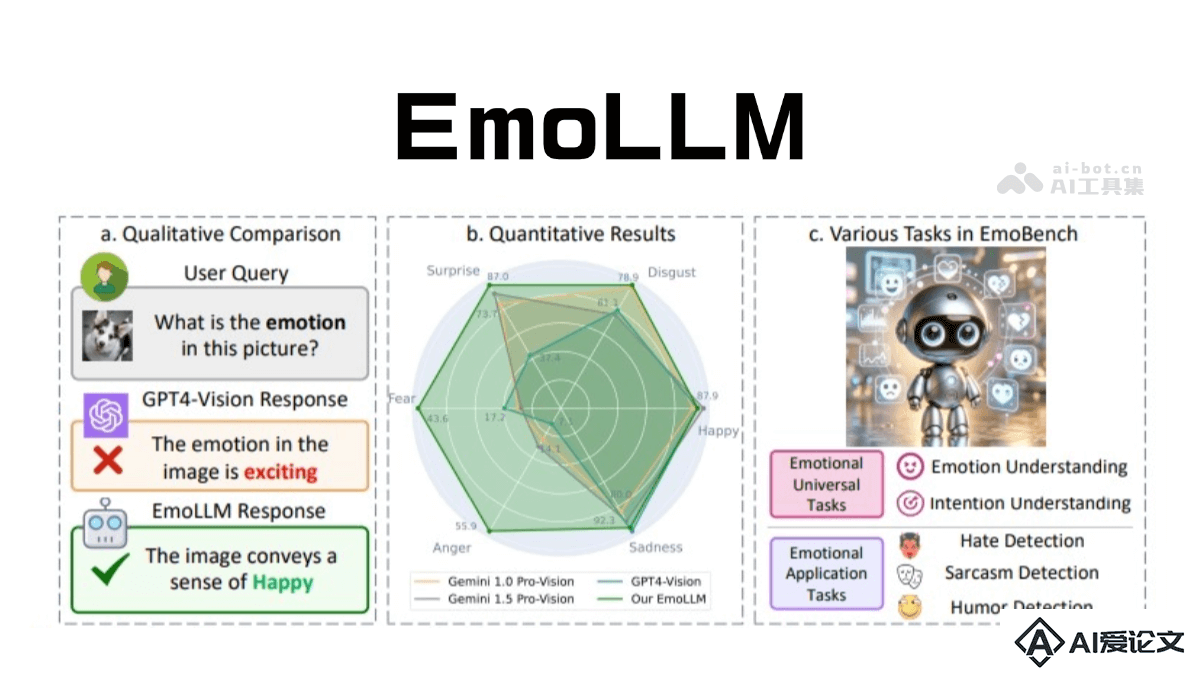

EmoLLM 是专注于心理健康支持的大型语言模型,通过多模态情感理解为用户提供情绪辅导和心理支持。结合了文本、图像、视频等多种数据形式,基于先进的多视角视觉投影技术,从不同角度捕捉情感线索,更全面地理解用户的情绪状态。EmoLLM 基于多种开源大语言模型进行指令微调,支持情绪识别、意图理解、幽默检测和仇恨检测等情感任务。

来源:爱论文 时间:2025-03-26 15:04:14

EmoLLM 是专注于心理健康支持的大型语言模型,通过多模态情感理解为用户提供情绪辅导和心理支持。结合了文本、图像、视频等多种数据形式,基于先进的多视角视觉投影技术,从不同角度捕捉情感线索,更全面地理解用户的情绪状态。EmoLLM 基于多种开源大语言模型进行指令微调,支持情绪识别、意图理解、幽默检测和仇恨检测等情感任务。

相关资讯

更多+

相关资讯

更多+

EmoLLM 是专注于心理健康支持的大型语言模型,通过多模态情感理解为用户提供情绪辅导和心理支持。结合了文本、图像、视频等多种数据形式,基于先进的多视角视觉投影技术,从不同角度捕捉情感线索,更全面地理解用户的情绪状态。

AI教程资讯

2023-04-14

2023-04-14

Step-Video V2 是上海阶跃星辰智能科技发布的升级版视频生成模型。该版本在多个核心技术领域进行了优化和创新,采用了更高压缩比的VAE模型以及深度优化的DiT架构,引入强化学习算法。能生成复杂的动态场景,如芭蕾舞、空手道等,同时支持丰富的镜头语言和基础文字生成。

AI教程资讯

2023-04-14

2023-04-14

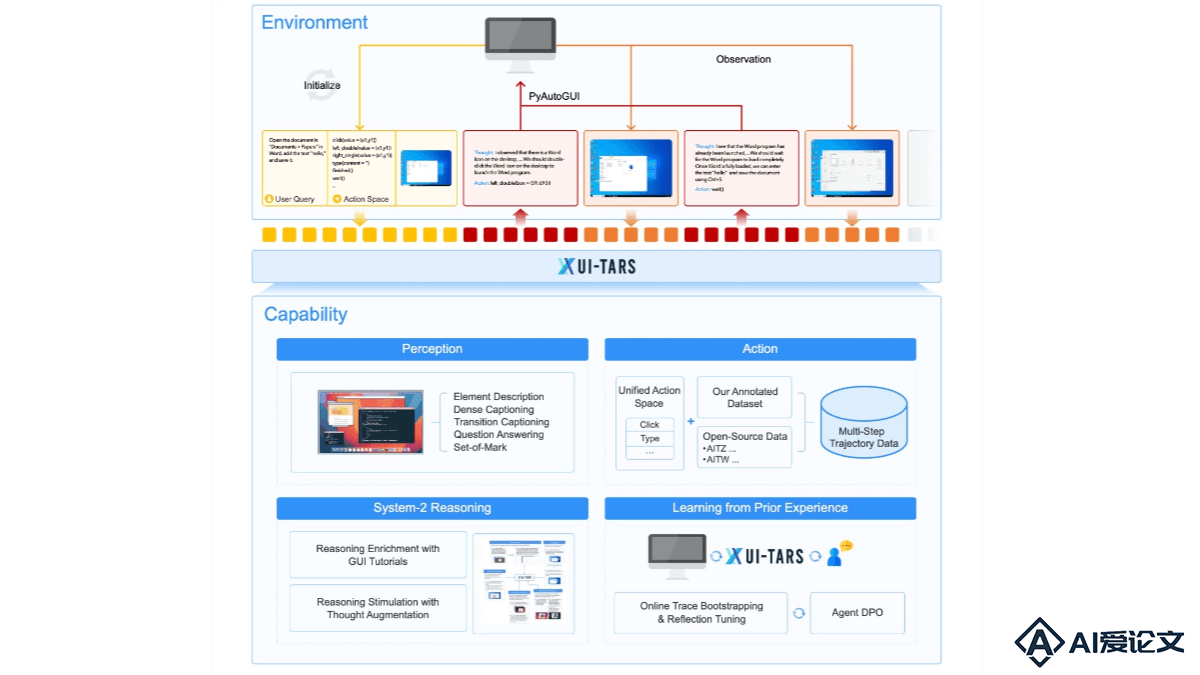

UI-TARS 是字节跳动推出的新一代原生图形用户界面(GUI)代理模型,通过自然语言实现对桌面、移动设备和网页界面的自动化交互。具备强大的感知、推理、行动和记忆能力,能实时理解动态界面,通过多模态输入(如文本、图像)执行复杂的任务。

AI教程资讯

2023-04-14

2023-04-14

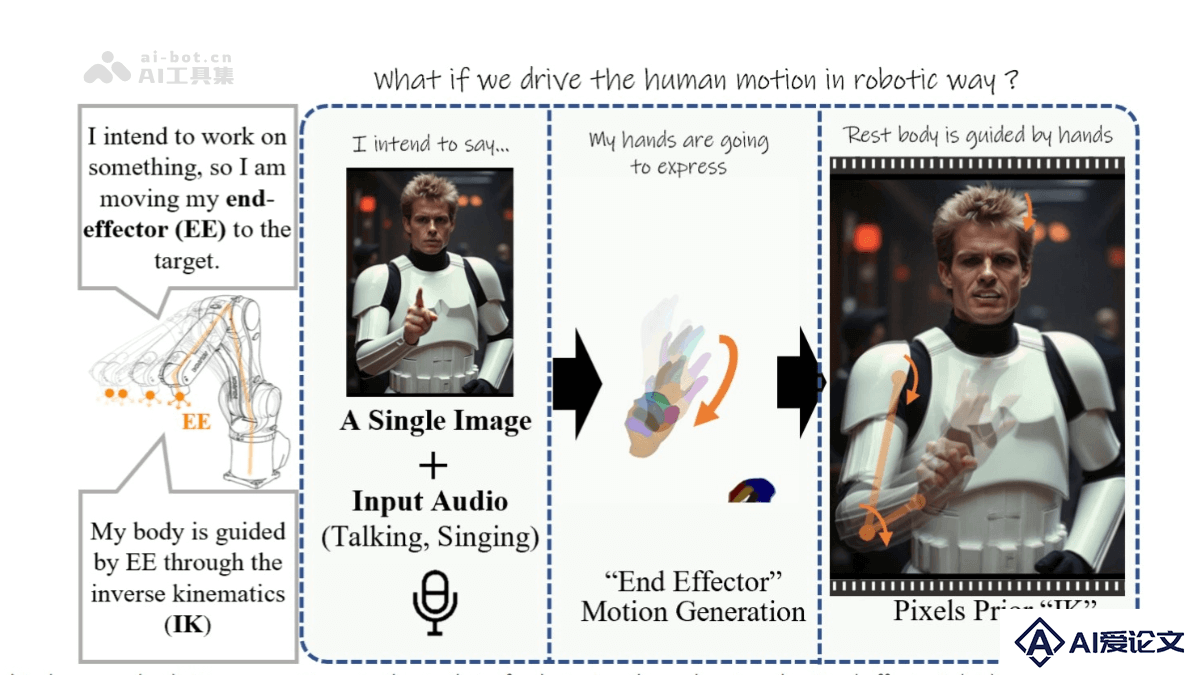

EMO2 (End-Effector Guided Audio-Driven Avatar Video Generation)是阿里巴巴智能计算研究院开发的音频驱动头像视频生成技术,全称为“末端效应器引导的音频驱动头像视频生成”。通过音频输入和一张静态人像照片,生成富有表现力的动态视频。

AI教程资讯

2023-04-14

2023-04-14

热门推荐

更多+

热门推荐

更多+