Ola是什么

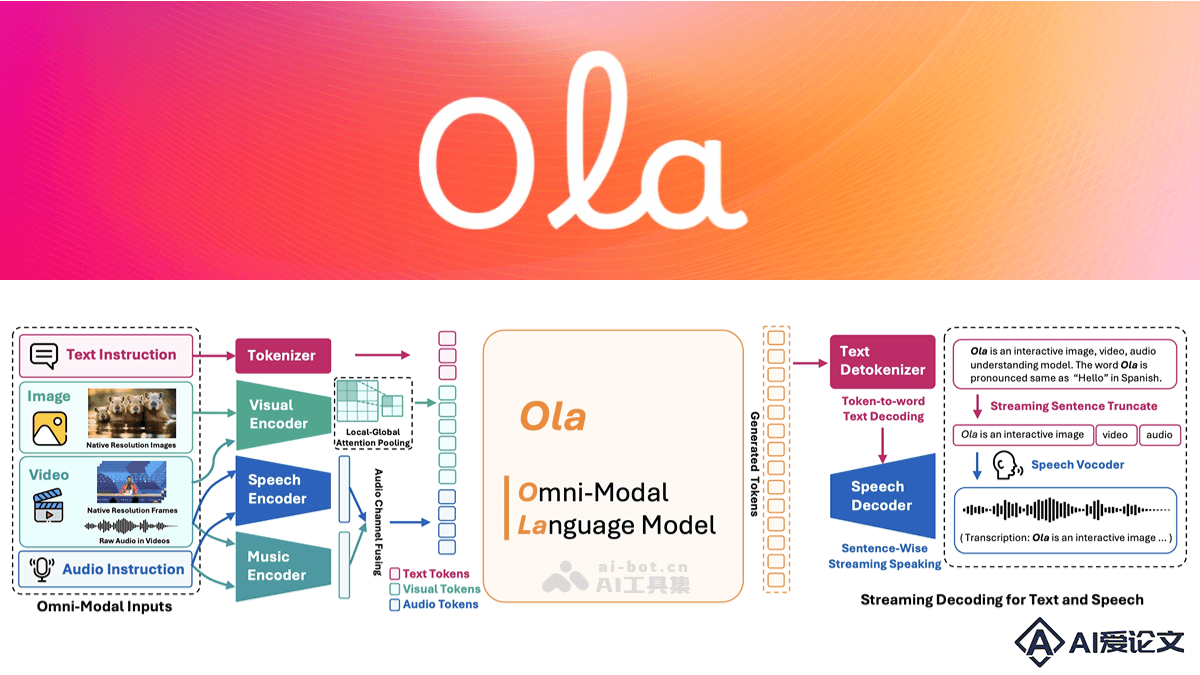

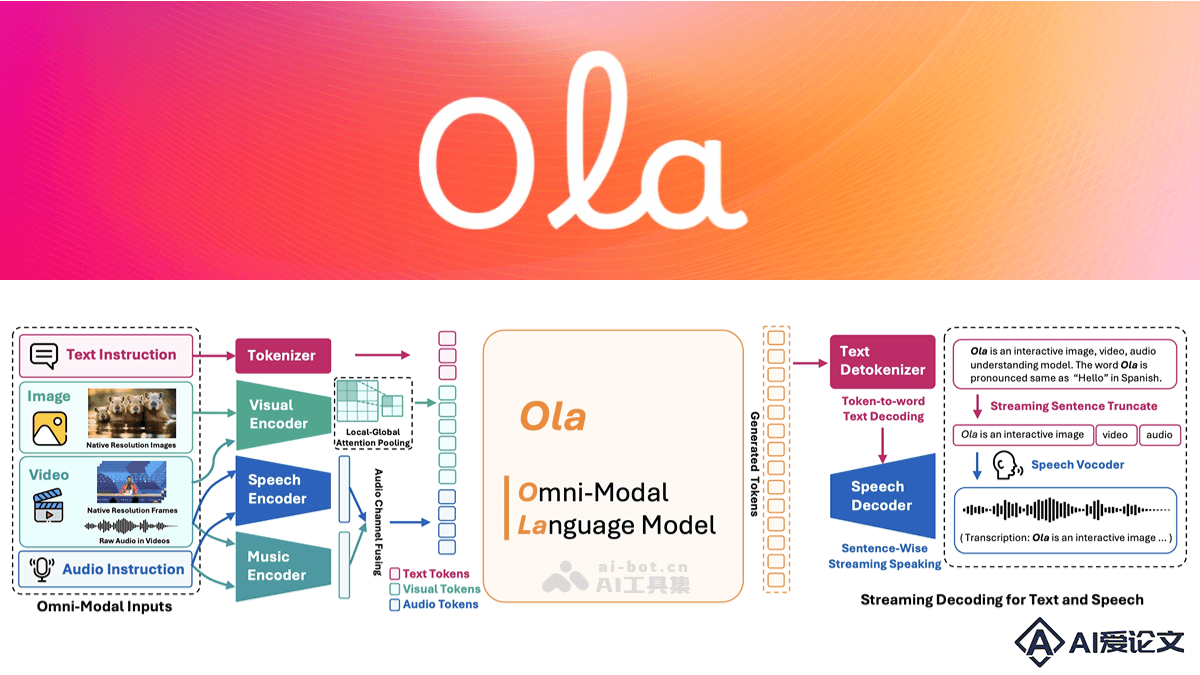

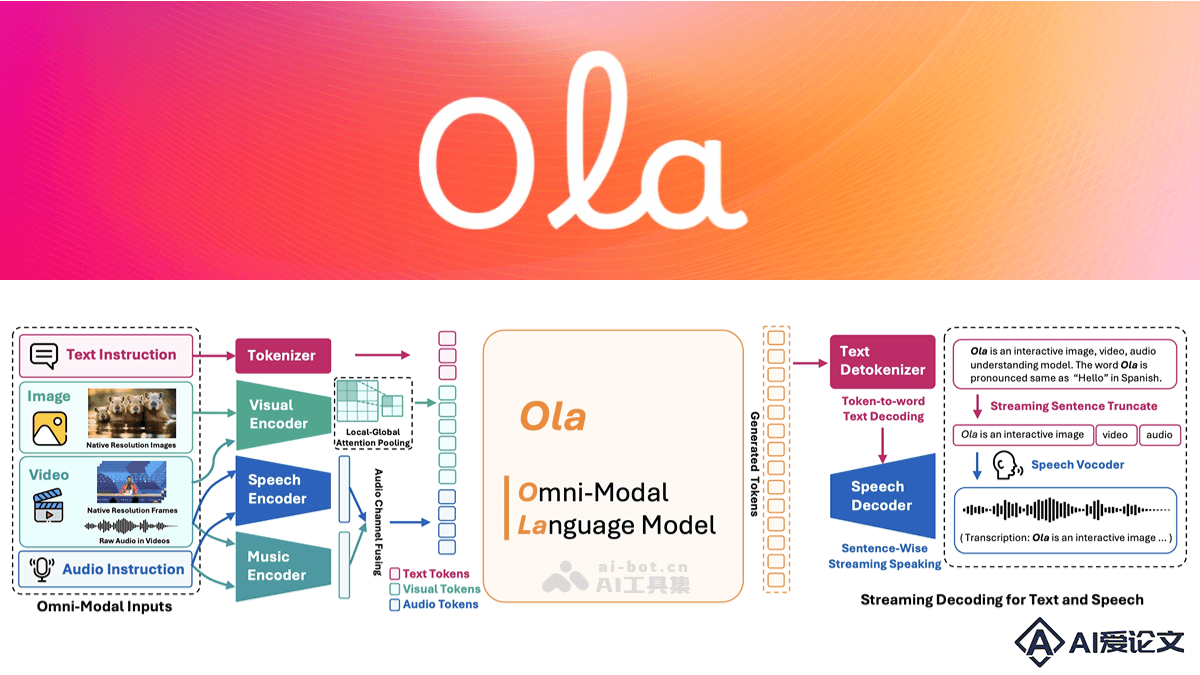

Ola是清华大学、腾讯 Hunyuan 研究团队和新加坡国立大学 S-Lab 合作开发的全模态语言模型。通过渐进式模态对齐策略,逐步扩展语言模型支持的模态,从图像和文本开始,再引入语音和视频数据,实现对多种模态的理解。Ola 的架构支持全模态输入,包括文本、图像、视频和音频,能同时处理这些输入。Ola 设计了逐句解码方案用于流式语音生成,提升交互体验。

来源:爱论文 时间:2025-03-21 17:23:59

Ola是清华大学、腾讯 Hunyuan 研究团队和新加坡国立大学 S-Lab 合作开发的全模态语言模型。通过渐进式模态对齐策略,逐步扩展语言模型支持的模态,从图像和文本开始,再引入语音和视频数据,实现对多种模态的理解。Ola 的架构支持全模态输入,包括文本、图像、视频和音频,能同时处理这些输入。Ola 设计了逐句解码方案用于流式语音生成,提升交互体验。

相关资讯

更多+

相关资讯

更多+

Ola是清华大学、腾讯 Hunyuan 研究团队和新加坡国立大学 S-Lab 合作开发的全模态语言模型。通过渐进式模态对齐策略,逐步扩展语言模型支持的模态,从图像和文本开始,再引入语音和视频数据,实现对多种模态的理解。

AI教程资讯

2023-04-14

2023-04-14

AlphaGeometry2 是谷歌 DeepMind 推出的先进的人工智能系统,专门用于解决国际数学奥林匹克竞赛(IMO)中的几何问题。结合了神经符号方法,将谷歌 Gemini 系列的语言模型与符号引擎协同工作,通过神经网络预测几何构造并由符号引擎进行逻辑推理。

AI教程资讯

2023-04-14

2023-04-14

EliGen是浙江大学和阿里巴巴集团联合开发的新型的实体级可控图像生成框架,通过引入区域注意力机制,无需额外参数即可将实体提示和任意形状的空间掩码无缝集成到扩散变换器中。EliGen包含50万高质量注释样本的数据集,用于训练模型以实现鲁棒且准确的实体级操控。

AI教程资讯

2023-04-14

2023-04-14

Hibiki是Kyutai Labs开源的用在同时语音翻译的解码器模型,能实时将一种语言的语音翻译成另一种语言的语音或文本。Hibiki基于多流语言模型架构,同步处理源语音和目标语音,联合生成文本和音频标记,实现语音到语音(S2ST)和语音到文本(S2TT)的翻译功能。

AI教程资讯

2023-04-14

2023-04-14

热门推荐

更多+

热门推荐

更多+